Различные типы регрессионных моделей, которые вам нужно знать

Опубликовано: 2022-01-07Проблемы регрессии являются обычным явлением в машинном обучении, и наиболее распространенным методом их решения является регрессионный анализ. Он основан на моделировании данных и включает в себя разработку линии наилучшего соответствия, которая проходит через все точки данных, так что расстояние между линией и каждой точкой данных является минимальным. Хотя существует множество различных методов регрессионного анализа, наиболее известными из них являются линейная и логистическая регрессия. Тип модели регрессионного анализа, которую мы используем, в конечном итоге будет зависеть от характера задействованных данных.

Давайте узнаем больше о регрессионном анализе и различных типах моделей регрессионного анализа.

Оглавление

Что такое регрессионный анализ?

Регрессионный анализ — это метод прогнозного моделирования для определения взаимосвязи между зависимыми (целевыми) переменными и независимыми переменными в наборе данных. Обычно он используется, когда целевая переменная содержит непрерывные значения, а зависимая и независимая переменные имеют линейную или нелинейную связь. Таким образом, методы регрессионного анализа находят применение при определении причинно-следственной связи между переменными, моделировании временных рядов и прогнозировании. Например, взаимосвязь между расходами компании на продажи и рекламу лучше всего изучать с помощью регрессионного анализа.

Типы регрессионного анализа

Существует множество различных методов регрессионного анализа, которые мы можем использовать для прогнозирования. Кроме того, использование каждого метода определяется такими факторами, как количество независимых переменных, форма линии регрессии и тип зависимой переменной.

Давайте разберемся с некоторыми из наиболее часто используемых методов регрессионного анализа:

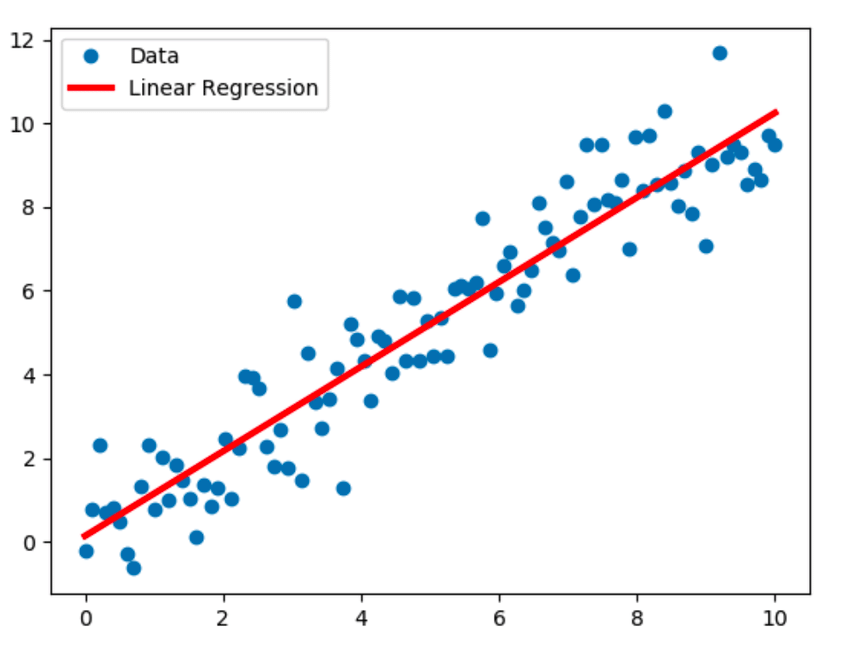

1. Линейная регрессия

Линейная регрессия является наиболее широко известным методом моделирования и предполагает наличие линейной зависимости между зависимой переменной (Y) и независимой переменной (X). Эта линейная зависимость устанавливается с помощью линии регрессии, также известной как линия наилучшего соответствия. Линейная зависимость представлена уравнением Y = c+m*X + e, где «c» — точка пересечения, «m» — наклон линии, а «e» — член ошибки.

Модель линейной регрессии может быть простой (с одной зависимой и одной независимой переменной) или множественной (с одной зависимой переменной и более чем одной независимой переменной).

Источник

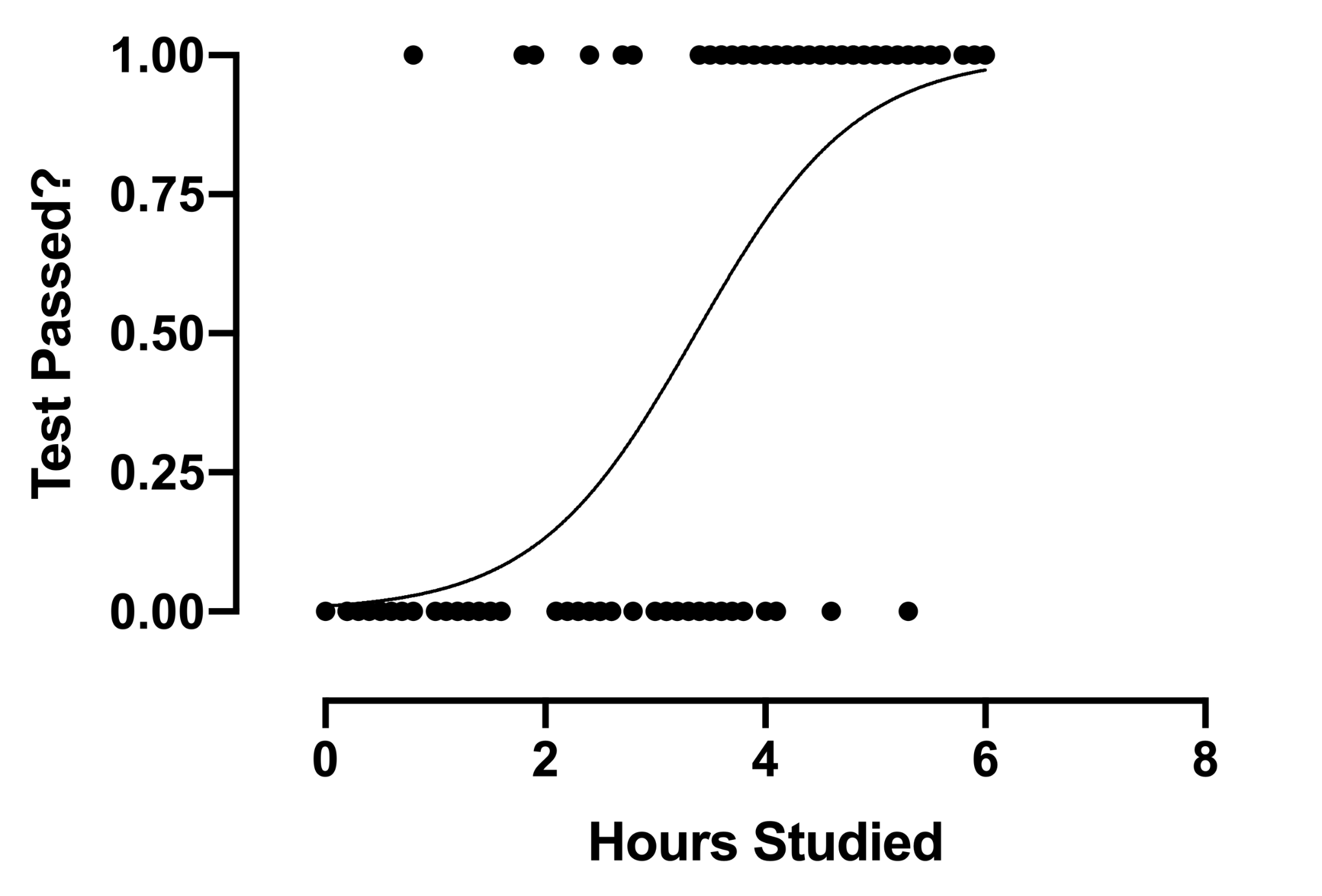

2. Логистическая регрессия

Метод логистического регрессионного анализа находит применение, когда зависимая переменная является дискретной. Другими словами, этот метод используется для оценки вероятности взаимоисключающих событий, таких как «годен/не годен», «истина/ложь», «0/1» и т. д. Следовательно, целевая переменная может иметь только одно из двух значений, а сигмовидная кривая представляет собой его связь с независимой переменной. Значение вероятности находится в диапазоне от 0 до 1.

Источник

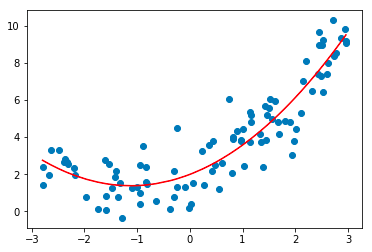

3. Полиномиальная регрессия

Метод полиномиального регрессионного анализа моделирует нелинейную связь между зависимой и независимой переменными. Это модифицированная форма модели множественной линейной регрессии, но линия наилучшего соответствия, проходящая через все точки данных, является изогнутой, а не прямой.

Источник

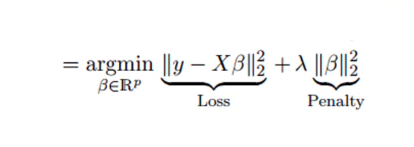

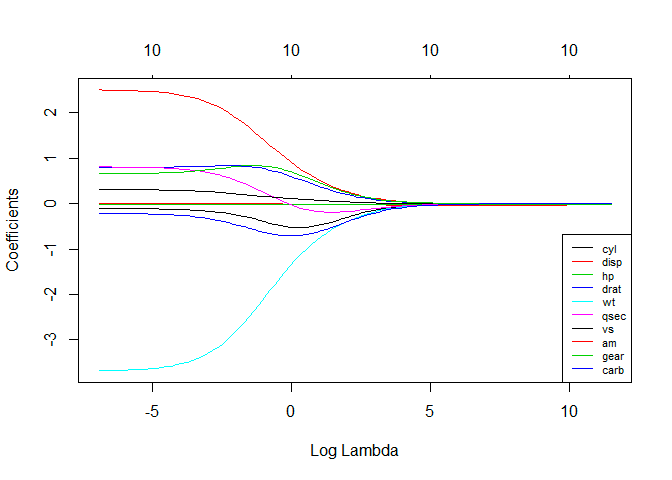

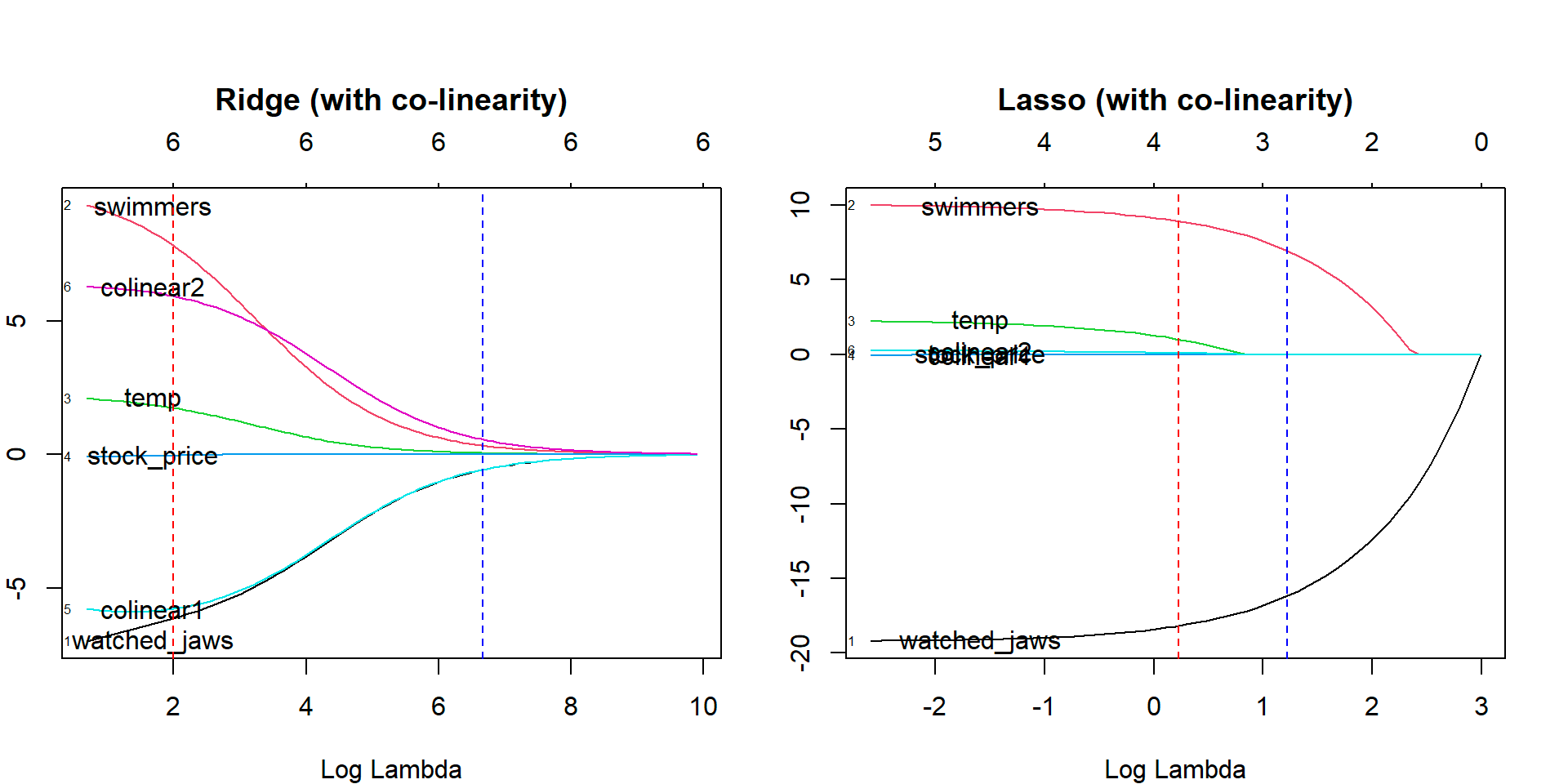

4. Регрессия хребта

Метод гребневого регрессионного анализа используется, когда данные демонстрируют мультиколлинеарность; то есть независимые переменные сильно коррелированы. Хотя оценки методом наименьших квадратов в мультиколлинеарности несмещены, их дисперсии достаточно велики, чтобы отклонить наблюдаемое значение от истинного значения. Гребневая регрессия минимизирует стандартные ошибки, внося некоторую погрешность в оценки регрессии.

Лямбда (λ) в уравнении гребневой регрессии решает проблему мультиколлинеарности.

Источник

Источник

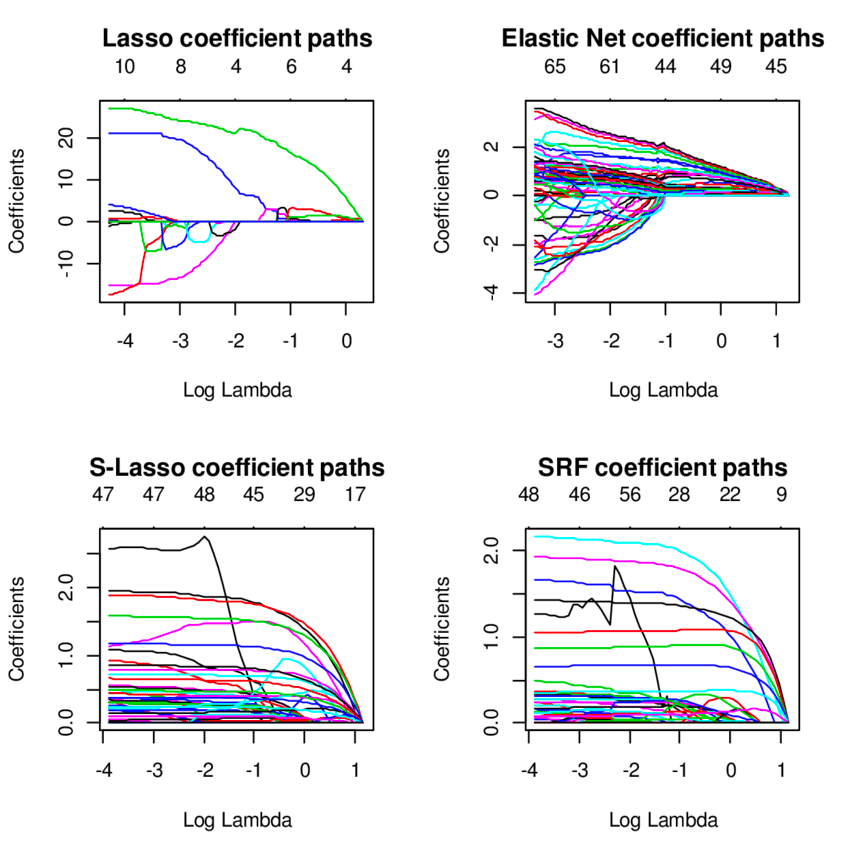

5. Лассо-регрессия

Как и регрессия гребня, метод регрессии лассо (наименьшее абсолютное сокращение и оператор выбора) снижает абсолютный размер коэффициента регрессии. Кроме того, метод лассо-регрессии использует выбор переменных, что приводит к уменьшению значений коэффициентов до абсолютного нуля.

Источник

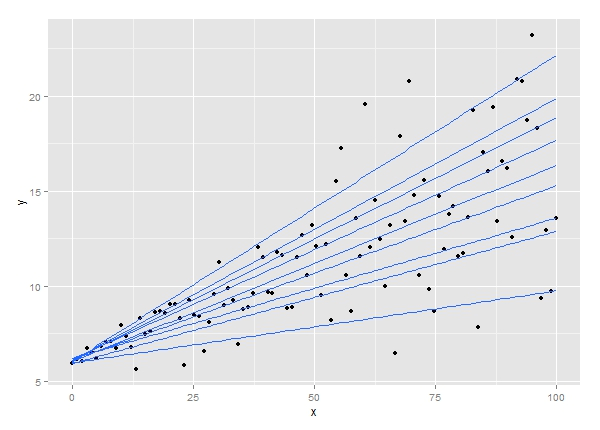

6. Квантильная регрессия

Метод квантильного регрессионного анализа является расширением линейного регрессионного анализа. Он используется, когда условия линейной регрессии не выполняются или данные имеют выбросы. Квантильная регрессия находит применение в статистике и эконометрике.

Источник

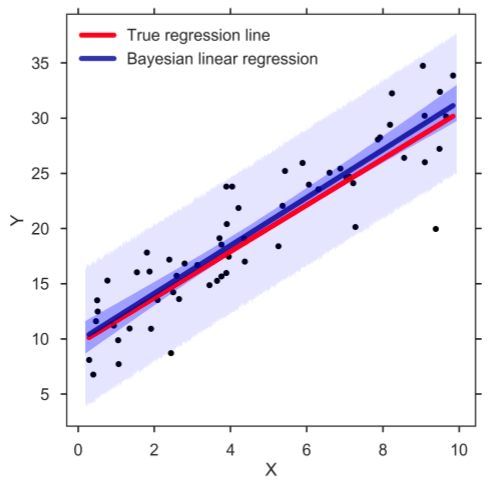

7. Байесовская линейная регрессия

Байесовская линейная регрессия — это один из типов методов регрессионного анализа в машинном обучении, который использует теорему Байеса для определения значения коэффициентов регрессии. Вместо поиска метода наименьших квадратов этот метод определяет апостериорное распределение признаков. В результате метод обладает большей стабильностью, чем простая линейная регрессия.

Источник

8. Регрессия основных компонентов

Метод регрессии основных компонентов обычно используется для анализа данных множественной регрессии с мультиколлинеарностью. Как и метод гребневой регрессии, метод регрессии основных компонентов минимизирует стандартные ошибки, придавая некоторую степень смещения оценкам регрессии. Этот метод состоит из двух этапов: сначала к обучающим данным применяется анализ основных компонентов, а затем преобразованные образцы используются для обучения регрессора.

9. Частичная регрессия методом наименьших квадратов

Метод частичной регрессии наименьших квадратов является одним из быстрых и эффективных методов регрессионного анализа, основанных на ковариации. Это полезно для задач регрессии, где число независимых переменных велико с вероятной мультиколлинеарностью между переменными. Этот метод сводит переменные к меньшему набору предикторов, которые затем используются для проведения регрессии.

10. Эластичная чистая регрессия

Метод эластичной сетевой регрессии представляет собой гибрид моделей регрессии гребня и лассо и полезен при работе с сильно коррелированными переменными. Он использует штрафы от методов регрессии гребня и лассо, чтобы упорядочить модели регрессии.

Источник

Резюме

Помимо методов регрессионного анализа, которые мы обсуждали здесь, в машинном обучении используется несколько других типов регрессионных моделей, таких как экологическая регрессия, пошаговая регрессия, регрессия складного ножа и робастная регрессия. Конкретный вариант использования всех этих различных типов методов регрессии зависит от характера доступных данных и уровня точности, который может быть достигнут. В целом регрессионный анализ имеет два основных преимущества. Вот они:

- Он указывает на связь между зависимой переменной и независимой переменной.

- Он показывает силу влияния независимых переменных на зависимую переменную.

Путь вперед: получите степень магистра наук в области машинного обучения и искусственного интеллекта

Вы ищете комплексную онлайн-программу, чтобы подготовиться к карьере в области машинного обучения и искусственного интеллекта?

upGrad предлагает степень магистра наук в области машинного обучения и искусственного интеллекта в сотрудничестве с Ливерпульским университетом Джона Мура и IIIT Bangalore для подготовки разносторонних специалистов по искусственному интеллекту и специалистов по данным.

Комплексная 20-месячная онлайн-программа специально разработана для работающих профессионалов, которые хотят освоить передовые концепции и навыки, такие как глубокое обучение, НЛП, графические модели, обучение с подкреплением и тому подобное. Кроме того, программа предназначена для создания прочной основы статистики наряду с ключевыми языками программирования и инструментами, такими как Python, Keras, TensorFlow, Kubernetes, MySQL и другими.

Основные моменты программы:

- Степень магистра Ливерпульского университета Джона Мурса.

- Executive PGP от IIIT Bangalore

- Более 40 живых сессий, более 12 тематических исследований и проектов, 11 заданий по кодированию, шесть завершающих проектов

- 25+ менторских сессий с экспертами отрасли

- 360-градусная помощь в карьере и поддержка в обучении

- Возможности одноранговой сети

Благодаря преподавательскому составу, педагогике, технологиям и отраслевым экспертам мирового класса upGrad стала крупнейшей платформой высшего образования в Южной Азии и оказала влияние на более чем 500 000 работающих профессионалов по всему миру. Зарегистрироваться Сегодня чтобы стать частью более чем 40 000 глобальной базы учащихся upGrad в более чем 80 странах!

1. Что такое определение регрессионного тестирования?

Регрессионное тестирование определяется как тип тестирования программного обеспечения, проводимого для проверки того, не повлияло ли изменение кода в программном обеспечении на функциональность существующего продукта. Это гарантирует, что продукт хорошо работает с новыми функциями или любыми изменениями существующих функций. Регрессионное тестирование включает в себя частичный или полный выбор ранее выполненных тестовых случаев, которые повторно выполняются для проверки условий работы существующих функций.

Каково назначение регрессионной модели?

Регрессионный анализ выполняется для одной из двух целей: для прогнозирования значения зависимой переменной, когда доступна некоторая информация о независимых переменных, или для прогнозирования влияния независимой переменной на зависимую переменную.

Регрессионный анализ выполняется для одной из двух целей: для прогнозирования значения зависимой переменной, когда доступна некоторая информация о независимых переменных, или для прогнозирования влияния независимой переменной на зависимую переменную.

Соответствующий размер выборки имеет важное значение для обеспечения точности и достоверности результатов. Хотя не существует эмпирического правила для определения надлежащего размера выборки в регрессионном анализе, некоторые исследователи рассматривают как минимум десять наблюдений для каждой переменной. Таким образом, если мы используем три независимые переменные, минимальный размер выборки составит 30. Многие исследователи также используют статистическую формулу для определения размера выборки.