Różne typy modeli regresji, które musisz znać

Opublikowany: 2022-01-07Problemy z regresją są powszechne w uczeniu maszynowym, a najczęstszą techniką ich rozwiązywania jest analiza regresji. Opiera się na modelowaniu danych i obejmuje opracowanie linii najlepszego dopasowania, która przechodzi przez wszystkie punkty danych, tak aby odległość między linią a każdym punktem danych była minimalna. Chociaż istnieje wiele różnych technik analizy regresji, najbardziej widoczne są regresja liniowa i logistyczna. Rodzaj modelu analizy regresji, którego użyjemy, będzie ostatecznie zależał od charakteru danych.

Dowiedzmy się więcej o analizie regresji i różnych typach modeli analizy regresji.

Spis treści

Co to jest analiza regresji?

Analiza regresji to predykcyjna technika modelowania służąca do określania relacji między zmiennymi zależnymi (docelowymi) a zmiennymi niezależnymi w zbiorze danych. Jest zwykle używany, gdy zmienna docelowa zawiera wartości ciągłe, a zmienne zależne i niezależne mają liniową lub nieliniową zależność. Tak więc techniki analizy regresji znajdują zastosowanie w określaniu związku przyczynowego między zmiennymi, modelowaniu szeregów czasowych i prognozowaniu. Na przykład związek między sprzedażą a wydatkami na reklamę firmy można najlepiej zbadać za pomocą analizy regresji.

Rodzaje analizy regresji

Istnieje wiele różnych rodzajów technik analizy regresji, których możemy użyć do prognozowania. Ponadto zastosowanie każdej techniki jest uzależnione od takich czynników, jak liczba zmiennych niezależnych, kształt linii regresji oraz rodzaj zmiennej zależnej.

Pozwól nam zrozumieć niektóre z najczęściej używanych metod analizy regresji:

1. Regresja liniowa

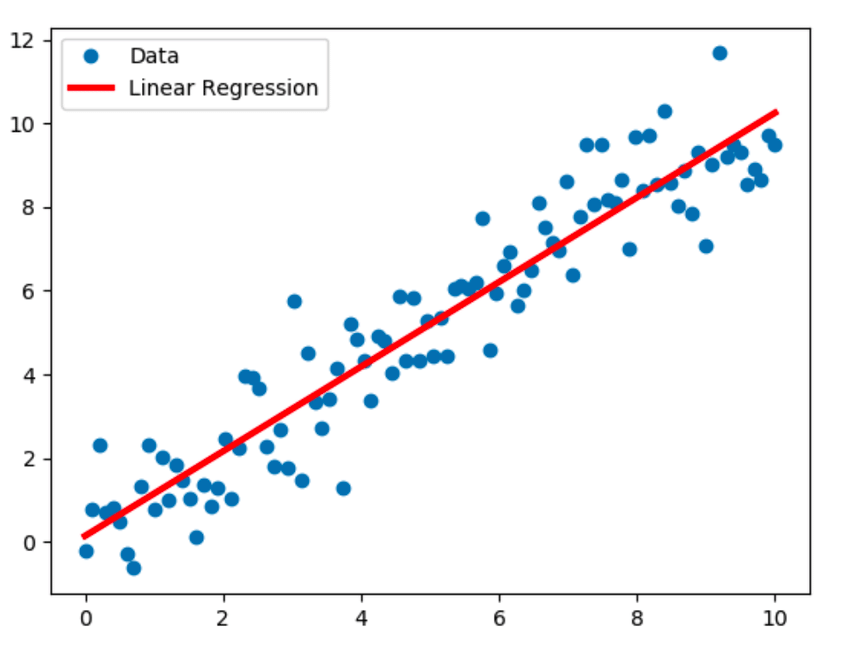

Regresja liniowa jest najbardziej znaną techniką modelowania i zakłada liniową zależność między zmienną zależną (Y) a zmienną niezależną (X). Ustanawia tę liniową zależność za pomocą linii regresji, znanej również jako linia najlepszego dopasowania. Zależność liniową przedstawia równanie Y = c+m*X + e, gdzie „c” to punkt przecięcia, „m” to nachylenie prostej, a „e” to składnik błędu.

Model regresji liniowej może być prosty (z jedną zmienną zależną i jedną zmienną niezależną) lub wielokrotny (z jedną zmienną zależną i więcej niż jedną zmienną niezależną).

Źródło

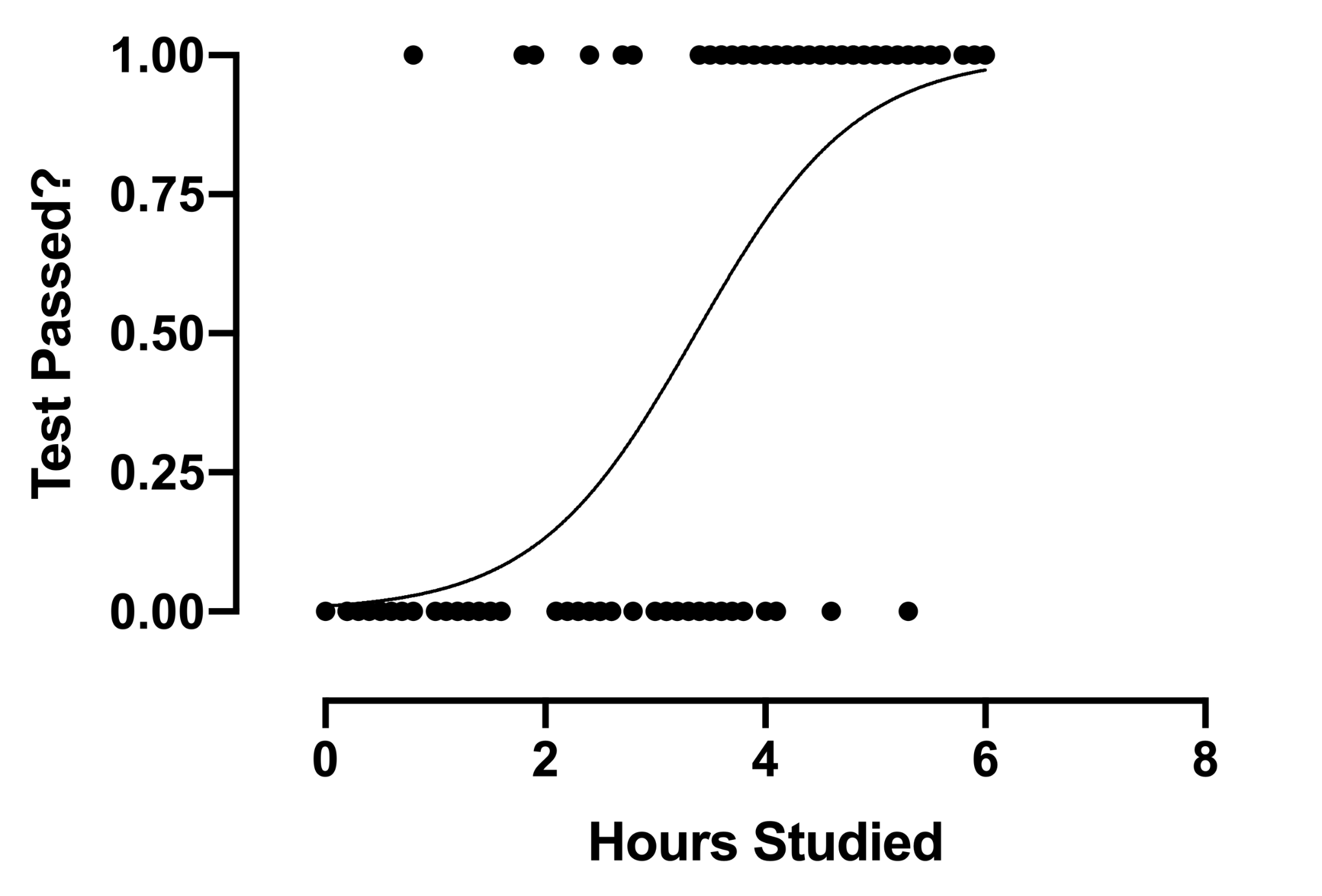

2. Regresja logistyczna

Technika analizy regresji logistycznej znajduje zastosowanie, gdy zmienna zależna jest dyskretna. Innymi słowy, technika ta służy do oszacowania prawdopodobieństwa wzajemnie wykluczających się zdarzeń, takich jak zaliczenie/niepowodzenie, prawda/fałsz, 0/1 itd. W związku z tym zmienna docelowa może mieć tylko jedną z dwóch wartości, a krzywa sigmoidalna reprezentuje jego związek ze zmienną niezależną. Wartość prawdopodobieństwa waha się od 0 do 1.

Źródło

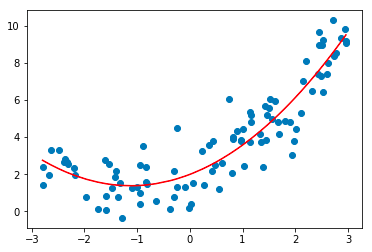

3. Regresja wielomianowa

Technika analizy regresji wielomianowej modeluje nieliniową zależność między zmienną zależną i niezależną. Jest to zmodyfikowana forma modelu regresji liniowej wielokrotnej, ale najlepiej dopasowana linia, która przechodzi przez wszystkie punkty danych, jest zakrzywiona, a nie prosta.

Źródło

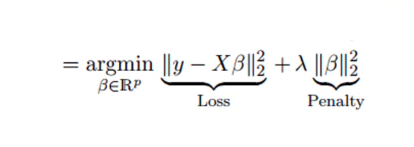

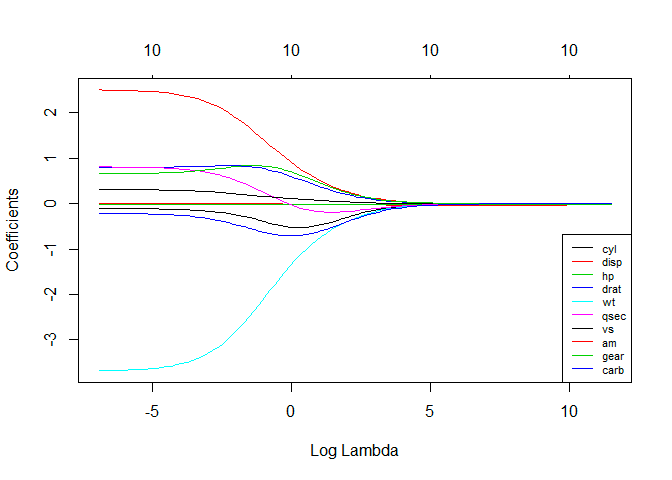

4. Regresja grzbietowa

Technika analizy regresji grzbietowej jest stosowana, gdy dane wykazują wielowspółliniowość; to znaczy, że zmienne niezależne są silnie skorelowane. Chociaż oszacowania metodą najmniejszych kwadratów w przypadku współliniowości są nieobciążone, ich wariancje są wystarczająco duże, aby odbiegać od wartości obserwowanej od wartości prawdziwej. Regresja grzbietowa minimalizuje błędy standardowe przez wprowadzenie pewnego stopnia błędu systematycznego w oszacowaniach regresji.

Lambda (λ) w równaniu regresji grzbietowej rozwiązuje problem wielowspółliniowości.

Źródło

Źródło

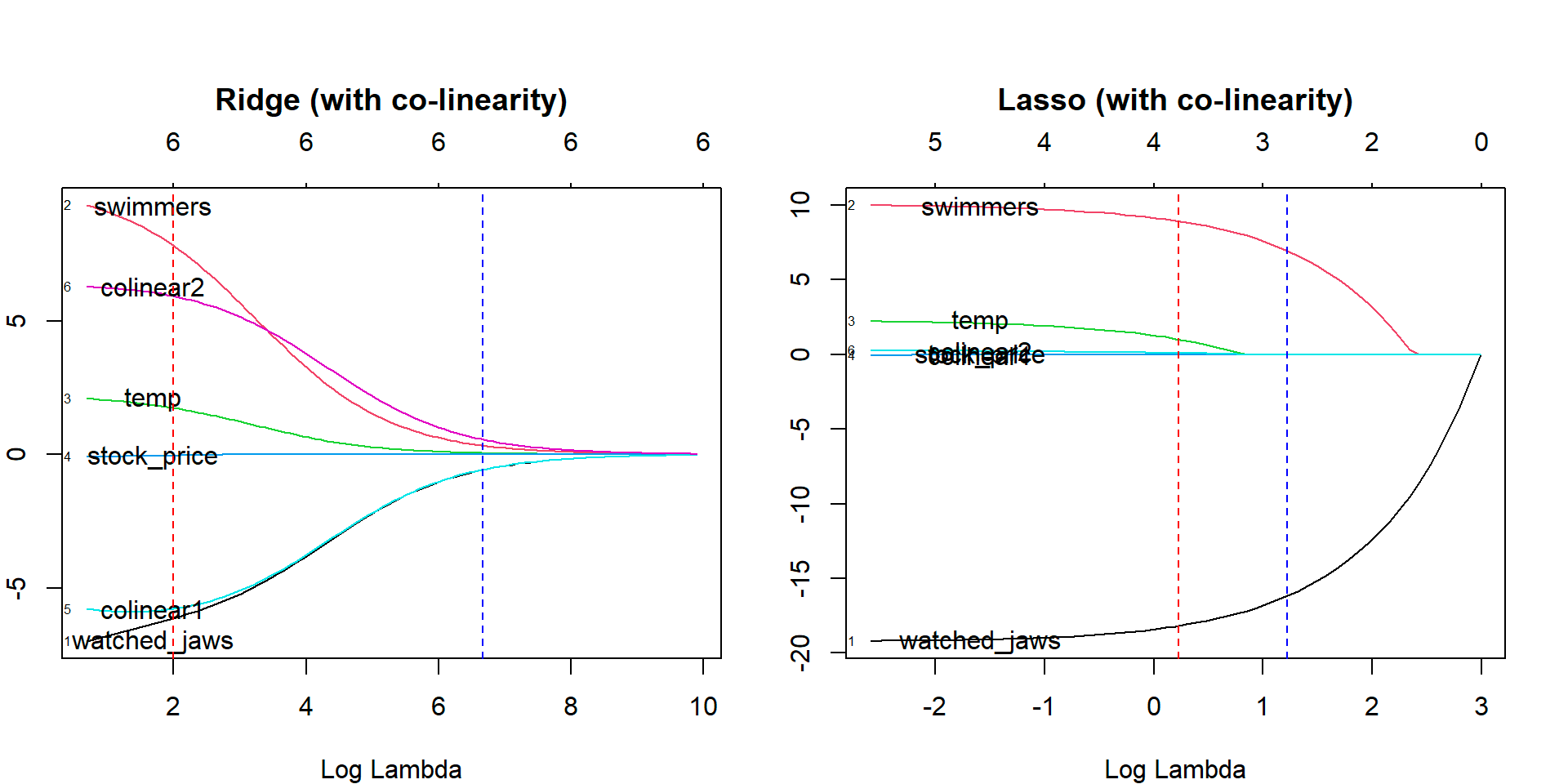

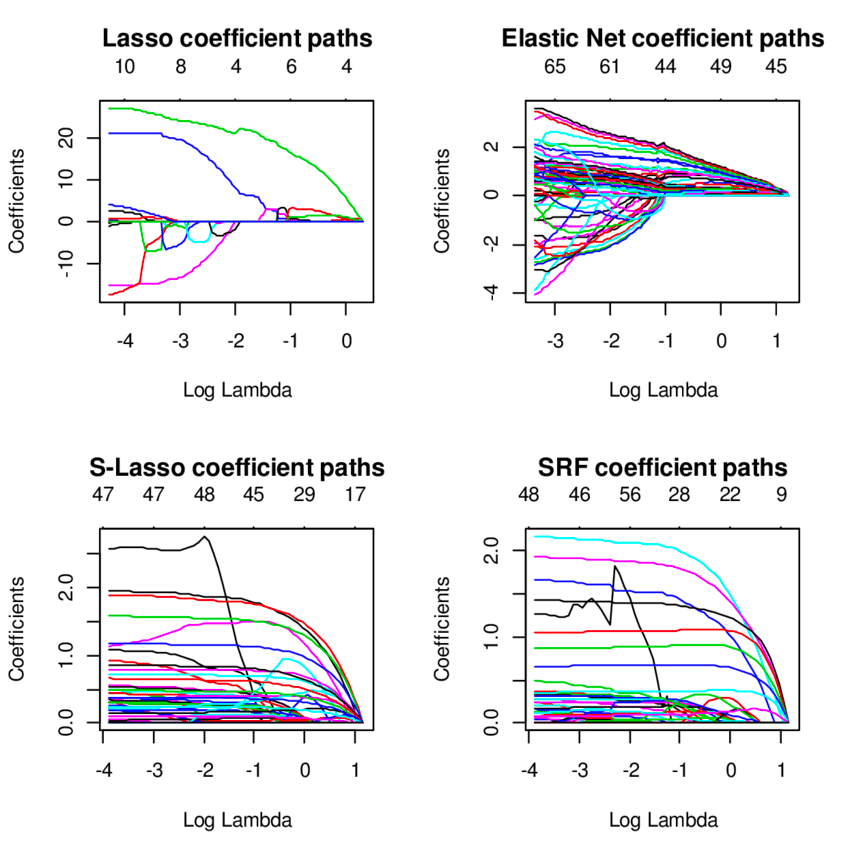

5. Regresja Lasso

Podobnie jak regresja grzbietowa, technika regresji lasso (Operator najmniejszego skurczu i selekcji) wpływa negatywnie na bezwzględny rozmiar współczynnika regresji. Ponadto technika regresji lasso wykorzystuje selekcję zmiennych, co powoduje kurczenie się wartości współczynników w kierunku zera bezwzględnego.

Źródło

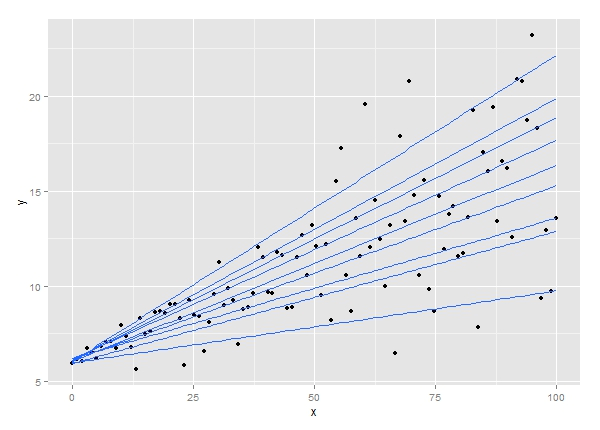

6. Regresja kwantylowa

Technika analizy regresji kwantylowej jest rozszerzeniem analizy regresji liniowej. Jest używany, gdy warunki regresji liniowej nie są spełnione lub dane zawierają wartości odstające. Regresja kwantylowa znajduje zastosowanie w statystyce i ekonometrii.

Źródło

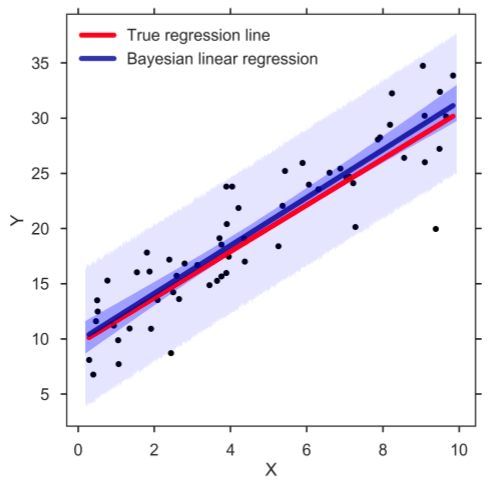

7. Bayesowska regresja liniowa

Bayesowska regresja liniowa jest jednym z rodzajów technik analizy regresji w uczeniu maszynowym, które wykorzystują twierdzenie Bayesa do określenia wartości współczynników regresji. Zamiast znajdowania najmniejszych kwadratów, ta technika określa rozkład cech w kierunku tylnym. W rezultacie technika ta ma większą stabilność niż prosta regresja liniowa.

Źródło

8. Regresja głównych składowych

Technika regresji głównych składowych jest zwykle używana do analizy danych regresji wielokrotnej z wielokoliniowością. Podobnie jak technika regresji grzbietowej, metoda regresji głównych składowych minimalizuje błędy standardowe, nadając pewien stopień błędu systematycznego szacunkom regresji. Technika składa się z dwóch etapów – najpierw analiza głównych składowych jest stosowana do danych uczących, a następnie przekształcone próbki są wykorzystywane do uczenia regresora.

9. Częściowa regresja najmniejszych kwadratów

Technika regresji cząstkowych najmniejszych kwadratów jest jednym z szybkich i skutecznych rodzajów technik analizy regresji opartych na kowariancji. Jest to korzystne w przypadku problemów regresji, w których liczba zmiennych niezależnych jest duża z prawdopodobną współliniowością między zmiennymi. Technika redukuje zmienne do mniejszego zestawu predyktorów, które są następnie wykorzystywane do przeprowadzenia regresji.

10. Elastyczna regresja netto

Technika regresji sieci elastycznej jest hybrydą modeli regresji grzbietu i lasso i jest przydatna w przypadku silnie skorelowanych zmiennych. Wykorzystuje kary z metod regresji ridge i lasso w celu uregulowania modeli regresji.

Źródło

Streszczenie

Oprócz omówionych tutaj technik analizy regresji, w uczeniu maszynowym wykorzystywanych jest kilka innych typów modeli regresji, takich jak regresja ekologiczna, regresja krokowa, regresja scyzoryka i solidna regresja. Konkretny przypadek użycia wszystkich tych różnych rodzajów technik regresji zależy od charakteru dostępnych danych i możliwego do osiągnięcia poziomu dokładności. Ogólnie rzecz biorąc, analiza regresji ma dwie podstawowe zalety. Są to następujące:

- Wskazuje związek między zmienną zależną a zmienną niezależną.

- Pokazuje siłę wpływu zmiennych niezależnych na zmienną zależną.

Way Forward: Zdobądź tytuł magistra nauk ścisłych w dziedzinie uczenia maszynowego i sztucznej inteligencji

Szukasz kompleksowego programu online, który przygotuje Cię do kariery w dziedzinie uczenia maszynowego i sztucznej inteligencji?

UpGrad oferuje tytuł magistra w dziedzinie uczenia maszynowego i sztucznej inteligencji we współpracy z Liverpool John Moores University i IIIT Bangalore, aby tworzyć wszechstronnych specjalistów AI i naukowców zajmujących się danymi.

Kompleksowy, 20-miesięczny program online jest specjalnie zaprojektowany dla pracujących profesjonalistów, którzy chcą opanować zaawansowane koncepcje i umiejętności, takie jak głębokie uczenie, NLP, modele graficzne, uczenie się przez wzmacnianie i tym podobne. Poza tym program ma na celu stworzenie solidnych podstaw w zakresie statystyki wraz z kluczowymi językami programowania i narzędziami, takimi jak Python, Keras, TensorFlow, Kubernetes, MySQL i innymi.

Najważniejsze punkty programu:

- Tytuł magistra na Uniwersytecie Johna Mooresa w Liverpoolu

- Wykonawczy PGP z IIIT Bangalore

- Ponad 40 sesji na żywo, ponad 12 studiów przypadków i projektów, 11 zadań związanych z kodowaniem, sześć projektów zwieńczenia

- Ponad 25 sesji mentorskich z ekspertami z branży

- 360-stopniowa pomoc w karierze i wsparcie w nauce

- Możliwości nawiązywania kontaktów peer-to-peer

Dzięki światowej klasy wykładowcom, pedagogice, technologii i ekspertom branżowym, upGrad stał się największą platformą wyższego EdTech w Azji Południowej i wpłynął na ponad 500 000 pracujących profesjonalistów na całym świecie. Zapisz się dzisiaj stać się częścią ponad 40 000 globalnej bazy uczniów upGrad w ponad 80 krajach!

1. Co to jest definicja testowania regresji?

Testowanie regresywne jest definiowane jako rodzaj testowania oprogramowania wykonywanego w celu sprawdzenia, czy zmiana kodu w oprogramowaniu nie miała wpływu na funkcjonalność istniejącego produktu. Zapewnia to, że produkt dobrze radzi sobie z nowymi funkcjonalnościami lub zmianami w jego dotychczasowych funkcjach. Testy regresyjne polegają na częściowym lub całkowitym wyborze wcześniej wykonanych przypadków testowych, które są ponownie wykonywane w celu sprawdzenia warunków pracy istniejących funkcjonalności.

Jaki jest cel modelu regresji?

Analiza regresji jest wykonywana w jednym z dwóch celów - w celu przewidzenia wartości zmiennej zależnej, gdy dostępne są pewne informacje dotyczące zmiennych niezależnych, lub w celu przewidzenia wpływu zmiennej niezależnej na zmienną zależną.

Analiza regresji jest wykonywana w jednym z dwóch celów - w celu przewidzenia wartości zmiennej zależnej, gdy dostępne są pewne informacje dotyczące zmiennych niezależnych, lub w celu przewidzenia wpływu zmiennej niezależnej na zmienną zależną.

Aby zapewnić dokładność i ważność wyników, niezbędna jest odpowiednia wielkość próbki. Chociaż nie ma praktycznej zasady określania właściwej wielkości próby w analizie regresji, niektórzy badacze biorą pod uwagę co najmniej dziesięć obserwacji na zmienną. Tak więc, jeśli użyjemy trzech niezależnych zmiennych, minimalna wielkość próby wyniesie 30. Wielu badaczy stosuje również wzór statystyczny, aby określić wielkość próby.