Estadística y modelo bayesiano: explicación

Publicado: 2021-09-29La técnica bayesiana es un enfoque estadístico utilizado en el análisis de datos y la estimación de parámetros. Este enfoque se basa en el teorema de Bayes.

Las estadísticas bayesianas siguen un principio único en el que ayudan a determinar la distribución de probabilidad conjunta para los parámetros observados y no observados mediante un modelo estadístico. El conocimiento de la estadística es fundamental para abordar los problemas analíticos en este escenario.

Desde la introducción del teorema de Bayes en la década de 1770 por Thomas Bayes, se ha mantenido como una herramienta indispensable en estadística. Los modelos bayesianos son un reemplazo clásico para los modelos frecuentistas, ya que las recientes innovaciones en estadísticas han ayudado a superar hitos en una amplia gama de industrias, incluida la investigación médica, la comprensión de búsquedas web y el procesamiento de lenguajes naturales (Procesamiento de lenguaje natural).

Por ejemplo, el Alzheimer es una enfermedad conocida por presentar un riesgo progresivo a medida que una persona envejece. Sin embargo, con la ayuda del teorema de Bayes, los médicos pueden estimar la probabilidad de que una persona tenga Alzheimer en el futuro. También se aplica al cáncer y otras enfermedades relacionadas con la edad a las que una persona se vuelve vulnerable en los últimos años de su vida.

Tabla de contenido

Estadísticas Frecuentes Vs Estadísticas Bayesianas

Las estadísticas frecuentes frente a las estadísticas bayesianas han sido constantemente un tema de controversia y pesadillas para los principiantes, quienes tienen dificultades para elegir entre los dos. A principios del siglo XX, las estadísticas bayesianas sufrieron problemas de desconfianza y aceptación. Sin embargo, con el tiempo, la gente se dio cuenta de la aplicabilidad de los modelos bayesianos y las soluciones precisas que produce.

He aquí un vistazo a las estadísticas frecuentes y las complejidades asociadas con ellas:

Estadísticas Frecuentes

Es una metodología inferencial muy utilizada en el mundo de la estadística. Analiza si un evento (mencionado como hipótesis) ha tenido lugar o no. También estima la probabilidad de que ocurra el evento durante el lapso del experimento. El experimento se repite hasta que se logra el resultado deseado.

Sus muestras de distribución son de tamaño real, y el experimento se repite teóricamente infinitas veces. Aquí hay un ejemplo que muestra cómo se pueden usar las estadísticas frecuentes para estudiar el lanzamiento de una moneda.

- La posibilidad de obtener cara al lanzar la moneda una vez es de 0,5 (1/2).

- El número de cabezas denota el número real de clientes potenciales obtenidos.

- La diferencia entre el número real de caras y el número esperado de caras aumentará a medida que aumente el número de lanzamientos.

Así que aquí, el resultado depende del número de veces que se repite el experimento. Es un gran inconveniente de las estadísticas frecuentes.

Otras fallas asociadas con sus técnicas de diseño e interpretación se hicieron evidentes en el siglo XX cuando la aplicación de estadísticas frecuentes a modelos numéricos estaba en su apogeo.

Limitaciones de las estadísticas frecuentes

Los tres principales defectos de las estadísticas frecuentes se enumeran a continuación:

1. Valores de p variables

Los valores de p medidos para una muestra con un tamaño fijo en un experimento con un punto final definido cambian con cualquier cambio en el punto final y el tamaño de la muestra. Da como resultado dos valores p para un solo dato que es incorrecto.

2. Intervalos de confianza inconsistentes

El IC (intervalo de confianza) depende únicamente del tamaño de la muestra. Hace que el potencial de frenado sea irrelevante.

3. Valores estimados de IC

Los intervalos de confianza no son una distribución de probabilidad y sus valores para un parámetro son solo una estimación y no valores reales.

Las tres razones anteriores dieron origen al enfoque bayesiano que aplica probabilidades a problemas estadísticos.

Nacimiento de la Estadística Bayesiana

El reverendo Thomas Bayes propuso por primera vez el enfoque bayesiano de las estadísticas en su ensayo escrito en 1763. Este enfoque fue publicado por Richard Price como una estrategia de probabilidad inversa para pronosticar eventos futuros basados en el pasado.

El enfoque se basa en el teorema de Bayes que se explica a continuación:

Teorema de Bayes

El axioma de probabilidad de Renyi examina las probabilidades condicionales, donde las posibilidades de que ocurra el evento A y el evento B son dependientes o condicionales. La probabilidad condicional básica se puede escribir como:

La probabilidad de que ocurra el evento B depende del evento A.

La ecuación anterior es la base de la regla de Bayes, una expresión matemática del teorema de Bayes que establece:

![]()

Aquí, ∩ denota intersección.

La regla de Bayes se puede escribir como:

La regla de Bayes es la base de las estadísticas bayesianas, donde la información disponible sobre un parámetro particular en un modelo estadístico se compara y actualiza con los datos recopilados.

El conocimiento previo se representa como la distribución anterior, que luego se compara y estudia con los datos observados o recopilados como una función de probabilidad para averiguar la distribución posterior.

Esta distribución posterior se utiliza para hacer predicciones sobre eventos futuros.

Las aplicaciones del enfoque bayesiano dependen de los siguientes parámetros:

- Definición del modelo previo y de datos

- Hacer inferencias relevantes

- Escudriñar y simplificar los modelos.

¿Qué son las redes neuronales bayesianas?

Las redes neuronales bayesianas (BNN, por sus siglas en inglés) son redes que crea cuando extiende redes estándar utilizando la metodología estadística y modifica la inferencia posterior para realizar un seguimiento del ajuste excesivo. Dado que es un enfoque bayesiano, existe una distribución de probabilidad asociada con los parámetros de las redes neuronales.

Se utilizan para resolver problemas complejos en los que no hay un flujo libre de datos disponible. Las redes neuronales bayesianas ayudan a controlar el sobreajuste en dominios como la biología molecular y el diagnóstico médico.

Se puede considerar una distribución completa de respuestas a una pregunta en lugar de solo una posibilidad utilizando redes neuronales bayesianas. Le ayudan a determinar la selección/comparación de modelos y abordar los problemas que implican la regularización.

Las estadísticas bayesianas ofrecen herramientas matemáticas para racionalizar y actualizar el conocimiento subjetivo sobre nuevos datos o evidencia científica. A diferencia del enfoque estadístico frecuente, funciona con base en la suposición de que las probabilidades dependen de la frecuencia de los eventos que se repiten bajo las mismas condiciones.

En resumen, la técnica bayesiana es una extensión de la suposición y la opinión de un individuo. El aspecto clave del modelo bayesiano que lo hace más eficiente es su comprensión de que las personas difieren en sus opiniones según el tipo de información que reciben.

Sin embargo, a medida que surgen nuevas evidencias y datos, los individuos tienen un punto de convergencia, la inferencia bayesiana . Esta actualización racional es la característica especial de la estadística bayesiana que la hace más efectiva en problemas analíticos.

Aquí, la probabilidad de 0 se aplica cuando no hay esperanza de que ocurra un evento, y la probabilidad de 1 se aplica cuando es seguro que el evento ocurrirá. Una probabilidad entre 0 y 1 da lugar a otros posibles resultados.

La regla de Bayes ahora se aplica para lograr una inferencia bayesiana para obtener una mejor inferencia del modelo.

¿Cómo se aplica la regla de Bayes para obtener la inferencia bayesiana?

Considere la ecuación:

P(θ|D) = P(D|θ.)P(θ) / P(D)

P(θ) denota la distribución previa,

P(θ|D) denota la creencia posterior,

P(D) representa la evidencia,

P(D|θ) indica la probabilidad.

El objetivo principal de la inferencia bayesiana es ofrecer un método racional y matemáticamente preciso para combinar las creencias con la evidencia para obtener creencias posteriores actualizadas. Las creencias posteriores se pueden usar como creencias previas cuando se generan nuevos datos. Por lo tanto, la inferencia bayesiana ayuda a actualizar las creencias continuamente con la ayuda de la regla de Bayes.

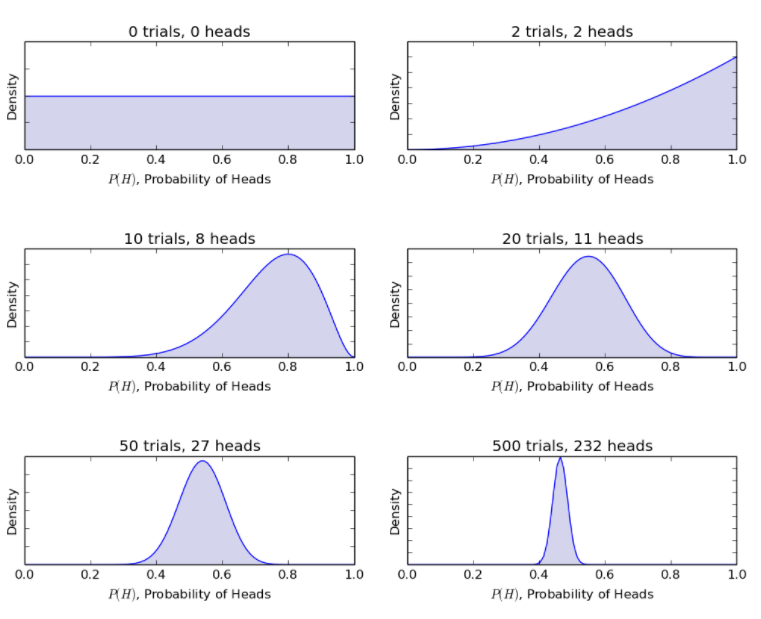

Considerando el mismo ejemplo de lanzamiento de moneda, el modelo bayesiano actualiza el procedimiento de creencias anteriores a posteriores con nuevos lanzamientos de moneda. El método bayesiano da las siguientes probabilidades.

Fuente

Así, el modelo bayesiano permite racionalizar un escenario incierto con información restringida a un escenario más definido con una cantidad considerable de datos.

Diferencias notables entre el modelo bayesiano y el modelo frecuentista

Estadísticas frecuentes

estadísticas bayesianas

El objetivo se considera como una estimación puntual y el CI

El objetivo se considera como una distribución posterior.

El procedimiento parte de las observaciones.

El proceso parte de la distribución previa

Cada vez que se realizan nuevas observaciones, el enfoque frecuentista vuelve a calcular el modelo existente.

Cada vez que se realizan nuevas observaciones, se actualiza la distribución posterior (ideología/hipótesis)

Ejemplos: Estimación de la media, prueba t y ANOVA.

Ejemplos: Estimación de la distribución posterior de la media y superposición de intervalos de alta densidad.

Ventajas de las estadísticas bayesianas

- Proporciona un medio orgánico y simple para combinar información preconcebida con un marco sólido con evidencia científica. La información pasada sobre un parámetro se puede utilizar para formar una distribución previa para futuras investigaciones. Las inferencias se adhieren al teorema de Bayes.

- Las inferencias de un modelo bayesiano son suposiciones lógicas y matemáticamente precisas y no crudas. La precisión permanece constante independientemente del tamaño de la muestra.

- Las estadísticas bayesianas siguen el principio de probabilidad. Cuando dos muestras diferentes tienen una función de probabilidad común para una creencia θ, todas las inferencias sobre la creencia deberían ser similares. Las técnicas estadísticas clásicas no siguen el principio de verosimilitud.

- Las soluciones de un análisis bayesiano se pueden interpretar fácilmente.

- Ofrece una plataforma propicia para varios modelos, como modelos jerárquicos y problemas de datos incompletos. Los cálculos de todos los modelos paramétricos se pueden rastrear virtualmente con la ayuda de otras técnicas numéricas.

Aplicaciones exitosas de modelos bayesianos a lo largo de la historia

Los métodos bayesianos tuvieron muchas aplicaciones exitosas durante la Segunda Guerra Mundial. Algunos de ellos se enumeran a continuación:

- Un estadístico ruso, Andrey Kolmogorov , utilizó con éxito métodos bayesianos para mejorar la eficiencia de la artillería rusa.

- Se utilizaron modelos bayesianos para descifrar los códigos de los submarinos alemanes.

- Un matemático estadounidense nacido en Francia, Bernard Koopman, ayudó a los aliados a identificar la ubicación de los submarinos alemanes con la ayuda de modelos bayesianos para interceptar las transmisiones de radio.

Si desea obtener más información sobre las estadísticas bayesianas, aquí está la Certificación avanzada en aprendizaje automático y nube de upGrad para comprender los conceptos subyacentes a través de estudios de casos y proyectos de la industria de la vida real. El curso de 12 meses es ofrecido por IIT Madras y apoya el aprendizaje a su propio ritmo.

Comuníquese con nosotros para obtener más detalles.

Los modelos estadísticos bayesianos se basan en procedimientos matemáticos y emplean el concepto de probabilidad para resolver problemas estadísticos. Proporcionan evidencia para que las personas confíen en nuevos datos y hagan pronósticos basados en parámetros del modelo. Es una técnica útil en estadística en la que nos basamos en nuevos datos e información para actualizar la probabilidad de una hipótesis utilizando el teorema de Bayes. Los modelos bayesianos son únicos en el sentido de que a todos los parámetros de un modelo estadístico, ya sean observados o no observados, se les asigna una distribución de probabilidad conjunta.¿Para qué se utiliza el modelo estadístico bayesiano?

¿Qué es la inferencia bayesiana?

¿Son únicos los modelos bayesianos?