Teorema de Bayes explicado con ejemplo – Guía completa

Publicado: 2021-06-14Tabla de contenido

Introducción

¿Qué es el teorema de Bayes?

El teorema de Bayes se usa para el cálculo de una probabilidad condicional donde la intuición a menudo falla. Aunque se usa ampliamente en probabilidad, el teorema también se está aplicando en el campo del aprendizaje automático. Su uso en el aprendizaje automático incluye el ajuste de un modelo a un conjunto de datos de entrenamiento y el desarrollo de modelos de clasificación.

¿Qué es la probabilidad condicional?

Una probabilidad condicional generalmente se define como la probabilidad de un evento dada la ocurrencia de otro evento.

- Si A y B son dos eventos, entonces la probabilidad condicional me puede designarse como P(A dado B) o P(A|B).

- La probabilidad condicional se puede calcular a partir de la probabilidad conjunta (A | B) = P(A, B) / P(B)

- La probabilidad condicional no es simétrica; Por ejemplo P(A | B) != P(B | A)

Otras formas de calcular la probabilidad condicional incluyen el uso de la otra probabilidad condicional, es decir

P(A|B) = P(B|A) * P(A) / P(B)

También se usa el reverso

P(B|A) = P(A|B) * P(B) / P(A)

Esta forma de cálculo es útil cuando es difícil calcular la probabilidad conjunta. De lo contrario, cuando la probabilidad condicional inversa está disponible, el cálculo a través de esto se vuelve fácil.

Este cálculo alternativo de probabilidad condicional se denomina Regla de Bayes o Teorema de Bayes. Lleva el nombre de la persona que lo describió por primera vez, "Reverendo Thomas Bayes".

La fórmula del teorema de Bayes

El teorema de Bayes es una forma de calcular la probabilidad condicional cuando la probabilidad conjunta no está disponible. A veces, no se puede acceder directamente al denominador. En tales casos, la forma alternativa de cálculo es la siguiente:

P(B) = P(B|A) * P(A) + P(B|no A) * P(no A)

Esta es la formulación del teorema de Bayes que muestra un cálculo alternativo de P(B).

P(A|B) = P(B|A) * P(A) / P(B|A) * P(A) + P(B|no A) * P(no A)

La fórmula anterior se puede describir con corchetes alrededor del denominador

P(A|B) = P(B|A) * P(A) / (P(B|A) * P(A) + P(B|no A) * P(no A))

Además, si tenemos P(A), entonces P(no A) se puede calcular como

P(no A) = 1 – P(A)

De manera similar, si tenemos P(no B|no A), entonces P(B|no A) se puede calcular como

P(B|no A) = 1 – P(no B|no A)

Teorema de Bayes de probabilidad condicional

El teorema de Bayes consta de varios términos cuyos nombres se dan en función del contexto de su aplicación en la ecuación.

La probabilidad posterior se refiere al resultado de P(A|B), y la probabilidad previa se refiere a P(A).

- P(A|B): Probabilidad posterior.

- P(A): Probabilidad previa.

De manera similar, P(B|A) y P(B) se denominan probabilidad y evidencia.

- P(B|A): Probabilidad.

- P(B): Evidencia.

Por lo tanto, el teorema de probabilidad condicional de Bayes se puede reformular como:

Posterior = Probabilidad * Previo / Evidencia

Si tenemos que calcular la probabilidad de que haya fuego dado que hay humo, entonces se utilizará la siguiente ecuación:

P(Fuego|Humo) = P(Humo|Fuego) * P(Fuego) / P(Humo)

Donde, P(Fuego) es el Precedente, P(Humo|Fuego) es la Probabilidad y P(Humo) es la evidencia.

Una ilustración del teorema de Bayes

Se describe un ejemplo del teorema de Bayes para ilustrar el uso del teorema de Bayes en un problema.

Problema

Están presentes tres cajas etiquetadas como A, B y C. Los detalles de las cajas son:

- La caja A contiene 2 bolas rojas y 3 negras.

- La caja B contiene 3 bolas rojas y 1 negra.

- Y la caja C contiene 1 bola roja y 4 bolas negras.

Las tres cajas son idénticas y tienen la misma probabilidad de ser recogidas. Por tanto, ¿cuál es la probabilidad de que la bola roja se haya recogido de la caja A?

Solución

Sea E el evento de que se recoja una bola roja y A, B y C denoten que la bola se saca de sus respectivas casillas. Por lo tanto, la probabilidad condicional sería P(A|E) que debe calcularse.

Las probabilidades existentes P(A) = P(B) = P (C) = 1/3, ya que todas las cajas tienen la misma probabilidad de ser seleccionadas.

P(E|A) = Número de bolas rojas en la casilla A / Número total de bolas en la casilla A = 2 / 5

Del mismo modo, P(E|B) = 3 / 4 y P(E|C) = 1 / 5

Entonces evidencia P(E) = P(E|A)*P(A) + P(E|B)*P(B) + P(E|C)*P(C)

= (2/5) * (1/3) + (3/4) * (1/3) + (1/5) * (1/3) = 0,45

Por lo tanto, P(A|E) = P(E|A) * P(A) / P(E) = (2/5) * (1/3) / 0,45 = 0,296

Ejemplo del Teorema de Bayes

El teorema de Bayes da la probabilidad de un "evento" con la información dada sobre las "pruebas".

- Hay una diferencia entre "eventos" y "pruebas". Por ejemplo, hay una prueba de enfermedad hepática, que es diferente de tener realmente la enfermedad hepática, es decir, un evento.

- Los eventos raros pueden tener una tasa de falsos positivos más alta.

Ejemplo 1

¿Cuál es la probabilidad de que un paciente tenga una enfermedad hepática si es alcohólico?

Aquí, “ser alcohólico” es la “prueba” (tipo de prueba de fuego) para la enfermedad hepática.

- A es el evento, es decir, “el paciente tiene una enfermedad hepática””.

Según registros anteriores de la clínica, se establece que el 10% de los pacientes que ingresan a la clínica sufren de enfermedad hepática.

Por lo tanto, P(A)=0.10

- B es la prueba de fuego de que “El paciente es alcohólico”.

Registros anteriores de la clínica mostraron que el 5% de los pacientes que ingresan a la clínica son alcohólicos.

Por lo tanto, P(B)=0.05

- Además, el 7% de los pacientes que son diagnosticados con enfermedad hepática, son alcohólicos. Esto define el B|A: la probabilidad de que un paciente sea alcohólico, dado que tiene una enfermedad hepática, es del 7%.

Como, según la fórmula del teorema de Bayes ,

P(A|B) = (0,07 * 0,1)/0,05 = 0,14

Por lo tanto, para un paciente alcohólico, las posibilidades de tener una enfermedad hepática son de 0,14 (14%).

Ejemplo2

- Los incendios peligrosos son raros (1%)

- Pero el humo es bastante común (10%) debido a las barbacoas,

- Y el 90% de los incendios peligrosos producen humo

¿Cuál es la probabilidad de un Incendio peligroso cuando hay Humo?

Cálculo

P(Fuego|Humo) =P(Fuego) P(Humo|Fuego)/P(Humo)

= 1% x 90%/10%

= 9%

Ejemplo 3

¿Cuál es la probabilidad de lluvia durante el día? Donde, Lluvia significa lluvia durante el día, y Nube significa mañana nublada.

La posibilidad de que llueva dada la nube se escribe P(Lluvia|Nube)

P(Lluvia|Nube) = P(Lluvia) P(Nube|Lluvia)/P(Nube)

P(Lluvia) es Probabilidad de Lluvia = 10%

P(Nube|Lluvia) es Probabilidad de Nube, dado que Lluvia sucede = 50%

P(Nube) es Probabilidad de Nube = 40%

P(Lluvia|Nube) = 0,1 x 0,5/0,4 = 0,125

Por lo tanto, un 12,5% de probabilidad de lluvia.

Aplicaciones

Existen varias aplicaciones del teorema de Bayes en el mundo real. Las pocas aplicaciones principales del teorema son:

1. Modelado de hipótesis

El teorema de Bayes encuentra una amplia aplicación en el aprendizaje automático aplicado y establece una relación entre los datos y un modelo. El aprendizaje automático aplicado utiliza el proceso de prueba y análisis de diferentes hipótesis sobre un conjunto de datos determinado.

Para describir la relación entre los datos y el modelo, el teorema de Bayes proporciona un modelo probabilístico.

P(h|D) = P(D|h) * P(h) / P(D)

Donde,

P(h|D): Probabilidad posterior de la hipótesis

P(h): Probabilidad previa de la hipótesis.

Un aumento en P(D) disminuye el P(h|D). Por el contrario, si P(h) y la probabilidad de observar los datos dados por la hipótesis aumentan, entonces la probabilidad de P(h|D) aumenta.

2. Teorema de Bayes para la Clasificación

El método de clasificación implica el etiquetado de un dato dado. Se puede definir como el cálculo de la probabilidad condicional de una etiqueta de clase dada una muestra de datos.

P(clase|datos) = (P(datos|clase) * P(clase)) / P(datos)

Donde P(clase|datos) es la probabilidad de clase dados los datos proporcionados.

El cálculo se puede realizar para cada clase. La clase que tiene la mayor probabilidad se puede asignar a los datos de entrada.

El cálculo de la probabilidad condicional no es factible en condiciones de un pequeño número de ejemplos. Por tanto, la aplicación directa del teorema de Bayes no es factible. Una solución al modelo de clasificación radica en el cálculo simplificado.

Clasificador bayesiano ingenuo

El teorema de Bayes considera que las variables de entrada dependen de otras variables que causan la complejidad del cálculo. Por lo tanto, se elimina la suposición y cada variable de entrada se considera una variable independiente. Como resultado, el modelo cambia de un modelo de probabilidad condicional dependiente a uno independiente. En última instancia, reduce la complejidad.

Esta simplificación del teorema de Bayes se conoce como Naive Bayes. Es ampliamente utilizado para clasificar y predecir modelos.

Clasificador Óptimo de Bayes

Este es un tipo de modelo probabilístico que involucra la predicción de un nuevo ejemplo dado el conjunto de datos de entrenamiento. Un ejemplo del clasificador óptimo de Bayes es "¿Cuál es la clasificación más probable de la nueva instancia dados los datos de entrenamiento?"

El cálculo de la probabilidad condicional de una nueva instancia dados los datos de entrenamiento se puede realizar a través de la siguiente ecuación

P(vj | D) = suma {h en H} P(vj | hola) * P(hola | D)

Donde vj es una nueva instancia a clasificar,

H es el conjunto de hipótesis para clasificar la instancia,

hola es una hipotesis dada,

P(vj | hi) es la probabilidad posterior de vi dada la hipótesis hi, y

P(hi | D) es la probabilidad posterior de la hipótesis hi dados los datos D.

3. Usos del teorema de Bayes en el aprendizaje automático

La aplicación más común del teorema de Bayes en el aprendizaje automático es el desarrollo de problemas de clasificación. Otras aplicaciones además de la clasificación incluyen optimización y modelos casuales.

optimización bayesiana

Siempre es una tarea desafiante encontrar una entrada que resulte en el costo mínimo o máximo de una función objetivo dada. La optimización bayesiana se basa en el teorema de Bayes y proporciona un aspecto para la búsqueda de un problema de optimización global. El método incluye la construcción de un modelo probabilístico (función sustituta), la búsqueda a través de una función de adquisición y la selección de muestras candidatas para evaluar la función objetivo real.

En el aprendizaje automático aplicado, la optimización bayesiana se utiliza para ajustar los hiperparámetros de un modelo de buen rendimiento.

Redes de creencias bayesianas

Las relaciones entre las variables pueden definirse mediante el uso de modelos probabilísticos. También se utilizan para el cálculo de probabilidades. Es posible que un modelo de probabilidad totalmente condicional no pueda calcular las probabilidades debido al gran volumen de datos. Naive Bayes ha simplificado el enfoque para el cálculo. Existe otro método más en el que se desarrolla un modelo basado en la dependencia condicional conocida entre variables aleatorias y la independencia condicional en otros casos. La red bayesiana muestra esta dependencia e independencia a través del modelo de gráfico probabilístico con aristas dirigidas. La dependencia condicional conocida se muestra como bordes dirigidos y las conexiones que faltan representan las independencias condicionales en el modelo.

4. Filtrado Bayesiano de Spam

El filtrado de spam es otra aplicación del teorema de Bayes. Dos eventos están presentes:

- Evento A: El mensaje es spam.

- Prueba X: El mensaje contiene ciertas palabras (X)

Con la aplicación del teorema de Bayes, se puede predecir si el mensaje es spam dados los “resultados de la prueba”. El análisis de las palabras de un mensaje puede calcular las posibilidades de que sea un mensaje de spam. Con el entrenamiento de filtros con mensajes repetidos se actualiza el hecho de que la probabilidad de tener ciertas palabras en el mensaje sería spam.

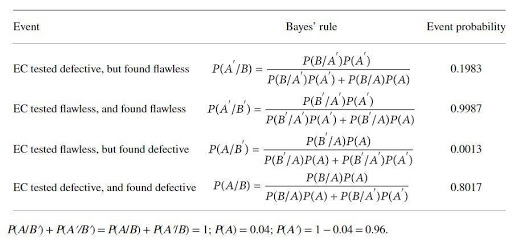

Una aplicación del teorema de Bayes con un ejemplo

Un productor de catalizador produce un dispositivo para probar defectos en cierto electrocatalizador (EC). El productor del catalizador afirma que la prueba es 97 % confiable si el EC es defectuoso y 99 % confiable cuando no tiene fallas. Sin embargo, se puede esperar que el 4% de dicho EC sea defectuoso en el momento de la entrega. La regla de Bayes se aplica para determinar la verdadera confiabilidad del dispositivo. Los conjuntos de eventos básicos son

A : el EC está defectuoso; A': la CE es impecable; B: se prueba que el EC es defectuoso; B': el EC está probado para ser impecable.

Las probabilidades serían

B/A: EC es (se sabe que es) defectuoso y se probó como defectuoso, P(B/A) = 0,97,

B'/A: EC (se sabe que es) defectuoso, pero se probó sin fallas, P(B'/A)=1-P(B/A)=0.03,

B/A': EC (se sabe que es) defectuoso, pero probado como defectuoso, P(B/A') = 1- P(B'/A')=0.01

B'/A: = EC (se sabe que es) impecable y probado sin fallas P(B'/A') = 0,99

Las probabilidades calculadas por el teorema de Bayes son:

La probabilidad de cálculo muestra que existe una alta posibilidad de rechazar EC sin fallas (alrededor del 20%) y una baja posibilidad de identificar EC defectuosas (alrededor del 80%).

Conclusión

Una de las características más llamativas de un teorema de Bayes es que a partir de unas pocas razones de probabilidad, se puede obtener una gran cantidad de información. Con los medios de probabilidad, la probabilidad de un evento anterior puede transformarse en la probabilidad posterior. Los enfoques del teorema de Bayes se pueden aplicar en áreas de estadística, epistemología y lógica inductiva.

Si está interesado en obtener más información sobre el teorema de Bayes, la IA y el aprendizaje automático, consulte el programa Executive PG de IIIT-B y upGrad en aprendizaje automático e IA, que está diseñado para profesionales que trabajan y ofrece más de 450 horas de capacitación rigurosa, más de 30 casos. estudios y asignaciones, estatus de exalumno IIIT-B, más de 5 proyectos prácticos finales y asistencia laboral con las mejores empresas.

¿Cuál es la hipótesis en el aprendizaje automático?

En el sentido más amplio, una hipótesis es cualquier idea o proposición que se va a probar. La hipótesis es una conjetura. El aprendizaje automático es una ciencia de dar sentido a los datos, especialmente los datos que son demasiado complejos para los humanos y, a menudo, se caracterizan por su aparente aleatoriedad. Cuando se utiliza el aprendizaje automático, una hipótesis es un conjunto de instrucciones que utiliza la máquina para analizar un determinado conjunto de datos y buscar los patrones que pueden ayudarnos a hacer predicciones o decisiones. Usando el aprendizaje automático, podemos hacer predicciones o decisiones con la ayuda de algoritmos.

¿Cuál es la hipótesis más general en el aprendizaje automático?

La hipótesis más general en el aprendizaje automático es que no hay comprensión de los datos. Las notaciones y los modelos son solo representaciones de esos datos, y esos datos son un sistema complejo. Por lo tanto, no es posible tener una comprensión completa y general de los datos. La única forma de aprender algo sobre los datos es usarlos y ver cómo cambian las predicciones con los datos. La hipótesis general es que los modelos solo son útiles en los dominios para los que han sido creados y no tienen una aplicación general a los fenómenos del mundo real. La hipótesis general es que los datos son únicos y el proceso de aprendizaje es único para cada problema.

¿Por qué una hipótesis debe ser medible?

Una hipótesis es medible cuando se le puede asignar un número a la variable cualitativa o cuantitativa. Esto se puede hacer haciendo una observación o realizando un experimento. Por ejemplo, si un vendedor está tratando de vender un producto, una hipótesis sería vender el producto a un cliente. Esta hipótesis es medible si se mide el número de ventas en un día o una semana.