إنشاء مهارات صوتية لـ Google Assistant و Amazon Alexa

نشرت: 2022-03-10على مدى العقد الماضي ، كان هناك تحول زلزالي نحو واجهات المحادثة. مع وصول الأشخاص إلى "ذروة الشاشة" وحتى البدء في تقليص استخدام أجهزتهم مع ميزات الرفاهية الرقمية التي يتم دمجها في معظم أنظمة التشغيل.

لمكافحة إجهاد الشاشة ، دخلت المساعدين الصوتيين إلى السوق ليصبحوا الخيار المفضل لاسترداد المعلومات بسرعة. تشير الإحصائيات المتكررة جيدًا إلى أن 50٪ من عمليات البحث سيتم إجراؤها عن طريق الصوت في عام 2020. وأيضًا ، مع زيادة التبني ، يعود الأمر للمطورين لإضافة "واجهات محادثة" و "مساعدين صوتيين" إلى حزام الأدوات الخاص بهم.

تصميم غير مرئي

بالنسبة للكثيرين ، يمكن أن يكون الشروع في مشروع واجهة المستخدم الصوتية (VUI) يشبه إلى حد ما الدخول إلى Unknown. اكتشف المزيد حول الدروس التي تعلمها ويليام ميريل عند تصميم الصوت. اقرأ مقالًا ذا صلة ←

ما هي واجهة المحادثة؟

واجهة المحادثة (التي يتم اختصارها أحيانًا إلى CUI ، هي أي واجهة بلغة بشرية. تميل إلى أن تكون واجهة أكثر طبيعية لعامة الناس من واجهة المستخدم الرسومية GUI ، التي اعتاد مطورو الواجهة الأمامية على بنائها. تتطلب واجهة المستخدم الرسومية البشر لمعرفة التركيبات المحددة للواجهة (أزرار التفكير وشرائح التمرير والقوائم المنسدلة).

هذا الاختلاف الرئيسي في استخدام اللغة البشرية يجعل CUI أكثر طبيعية للناس ؛ يتطلب القليل من المعرفة ويضع عبء الفهم على الجهاز.

عادةً ما تأتي CUIs في شكلين: Chatbots و Voice Assistants. شهد كلاهما ارتفاعًا هائلاً في الإقبال على مدار العقد الماضي بفضل التقدم في معالجة اللغة الطبيعية (NLP).

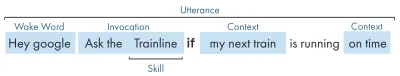

فهم المصطلحات اللغوية المتخصصة

| الكلمة الرئيسية | المعنى |

|---|---|

| المهارة / العمل | تطبيق صوتي يمكنه تحقيق سلسلة من المقاصد |

| نية | الإجراء المقصود للمهارة أن تفي به ، ما يريد المستخدم أن تفعله المهارة ردًا على ما يقوله. |

| الكلام | الجملة التي يقولها المستخدم أو ينطقها. |

| استيقظ كلمة | الكلمة أو العبارة المستخدمة لبدء استماع المساعد الصوتي ، على سبيل المثال ، "مرحبًا google" أو "Alexa" أو "Hey Siri" |

| سياق الكلام | أجزاء المعلومات السياقية داخل الكلام ، والتي تساعد المهارة على تحقيق النية ، على سبيل المثال "اليوم" ، "الآن" ، "عندما أصل إلى المنزل". |

ما هو مساعد الصوت؟

المساعد الصوتي هو جزء من برنامج قادر على معالجة اللغة الطبيعية (NLP). يتلقى أمرًا صوتيًا ويعيد الإجابة بتنسيق صوتي. في السنوات الأخيرة ، يتوسع نطاق كيفية التعامل مع المساعد ويتطور ، لكن جوهر التكنولوجيا هو اللغة الطبيعية ، والكثير من الحسابات ، واللغة الطبيعية.

لأولئك الذين يبحثون عن مزيد من التفاصيل:

- يتلقى البرنامج طلبًا صوتيًا من المستخدم ، ويقوم بمعالجة الصوت إلى مقاطع صوتية ، وهي اللبنات الأساسية للغة.

- بفضل سحر الذكاء الاصطناعي (على وجه التحديد تحويل الكلام إلى نص) ، يتم تحويل هذه الصوتيات إلى سلسلة من الطلب التقريبي ، ويتم الاحتفاظ بهذا داخل ملف JSON الذي يحتوي أيضًا على معلومات إضافية حول المستخدم والطلب والجلسة.

- ثم تتم معالجة JSON (عادةً في السحابة) للعمل على سياق الطلب والغرض منه.

- بناءً على النية ، يتم إرجاع الاستجابة ، مرة أخرى ضمن استجابة JSON أكبر ، إما كسلسلة أو SSML (المزيد عن ذلك لاحقًا)

- تتم معالجة الاستجابة مرة أخرى باستخدام AI (بشكل طبيعي العكس - تحويل النص إلى كلام) والذي يتم إرجاعه بعد ذلك إلى المستخدم.

هناك الكثير مما يجري هناك ، ومعظمها لا يتطلب تفكيرًا ثانويًا. لكن كل منصة تفعل ذلك بشكل مختلف ، وتتطلب الفروق الدقيقة في النظام الأساسي مزيدًا من الفهم.

الأجهزة التي تدعم الصوت

متطلبات الجهاز ليكون قادرًا على الحصول على مساعد صوتي منخفضة جدًا. تتطلب ميكروفونًا واتصالًا بالإنترنت ومكبر صوت. توفر مكبرات الصوت الذكية مثل Nest Mini و Echo Dot هذا النوع من التحكم الصوتي منخفض الدقة.

يأتي بعد ذلك في الترتيب صوت + شاشة ، يُعرف هذا باسم جهاز "متعدد الوسائط" (المزيد حول هذه الأجهزة لاحقًا) ، وهي أجهزة مثل Nest Hub و Echo Show. نظرًا لأن الهواتف الذكية تتمتع بهذه الوظيفة ، فيمكن اعتبارها أيضًا نوعًا من الأجهزة التي تدعم الصوت متعدد الوسائط.

مهارات الصوت

أولاً ، كل منصة لها اسم مختلف لـ "المهارات الصوتية" ، أما أمازون فهي تستخدم المهارات ، والتي سألتزم بها كمصطلح مفهوم عالميًا. تختار Google "الإجراءات" ، وتختار Samsung "الكبسولات".

تتمتع كل منصة بمهاراتها الخاصة ، مثل السؤال عن الوقت والطقس والألعاب الرياضية. يمكن استدعاء المهارات التي صنعها مطورون (طرف ثالث) بعبارة محددة ، أو ، إذا كانت المنصة تعجبها ، يمكن الاستناد إليها ضمنيًا ، بدون عبارة رئيسية.

استدعاء صريح : "مرحبًا Google ، تحدث إلى <اسم التطبيق>."

تم تحديد المهارة التي يتم طلبها صراحةً:

التذرع الضمني : "مرحبًا يا Google ، كيف هو الطقس اليوم؟"

ومن ضمن سياق الطلب الخدمة التي يريدها المستخدم.

ما هي المساعِدات الصوتية الموجودة؟

في السوق الغربية ، المساعدين الصوتيين هم إلى حد كبير سباق ثلاثي الأحصنة. لدى Apple و Google و Amazon مناهج مختلفة جدًا لمساعديهم ، وعلى هذا النحو ، فهي تجذب أنواعًا مختلفة من المطورين والعملاء.

Apple's Siri

اسم الجهاز : "Siri"

عبارة التنبيه : "يا Siri"

لدى Siri أكثر من 375 مليون مستخدم نشط ، ولكن من أجل الإيجاز ، لا أخوض في الكثير من التفاصيل لـ Siri. على الرغم من أنه قد يتم اعتماده بشكل جيد عالميًا ، ويتم استخدامه في معظم أجهزة Apple ، إلا أنه يتطلب من المطورين أن يكون لديهم بالفعل تطبيق على إحدى منصات Apple ويكون مكتوبًا بسرعة (بينما يمكن كتابة الآخرين في المفضلة لدى الجميع: Javascript). ما لم تكن مطور تطبيقات يرغب في توسيع عرض تطبيقه ، يمكنك حاليًا تخطي Apple السابق حتى يفتح النظام الأساسي الخاص به.

مساعد جوجل

أسماء الأجهزة : "Google Home ، Nest"

عبارة التنبيه : "Hey Google"

تمتلك Google أكبر عدد من الأجهزة الثلاثة الكبرى ، مع أكثر من مليار جهاز حول العالم ، ويرجع ذلك في الغالب إلى كتلة أجهزة Android التي تحتوي على مساعد Google ، فيما يتعلق بالسماعات الذكية المخصصة لها ، فإن الأرقام أصغر قليلاً. تتمثل مهمة Google الشاملة مع مساعدها في إسعاد المستخدمين ، وكانوا دائمًا بارعين جدًا في توفير واجهات خفيفة وبديهية.

هدفهم الأساسي على النظام الأساسي هو استخدام الوقت - مع فكرة أن يصبحوا جزءًا منتظمًا من الروتين اليومي للعملاء. على هذا النحو ، فإنها تركز في المقام الأول على المنفعة ، والمتعة العائلية ، والتجارب المبهجة.

تكون المهارات التي تم إنشاؤها لـ Google أفضل عندما تكون عبارة عن قطع تفاعلية وألعاب ، مع التركيز بشكل أساسي على المرح المناسب للعائلة. إن إضافتهم الأخيرة للوحة القماشية للألعاب هي شهادة على هذا النهج. تعتبر منصة Google أكثر صرامة فيما يتعلق بتقديم المهارات ، وعلى هذا النحو ، فإن دليلهم أصغر كثيرًا.

أمازون أليكسا

أسماء الأجهزة : "Amazon Fire ، Amazon Echo"

عبارة الاستيقاظ : "Alexa"

تجاوزت أمازون 100 مليون جهاز في عام 2019 ، ويأتي هذا في الغالب من مبيعات مكبرات الصوت الذكية والشاشات الذكية ، فضلاً عن نطاقها "الناري" أو الأجهزة اللوحية وأجهزة البث.

تميل المهارات التي تم إنشاؤها لـ Amazon إلى أن تستهدف شراء المهارات. إذا كنت تبحث عن نظام أساسي لتوسيع التجارة الإلكترونية / الخدمة الخاصة بك ، أو تقدم اشتراكًا ، فإن أمازون تناسبك. ومع ذلك ، فإن ISP ليس شرطًا لمهارات Alexa ، فهم يدعمون جميع أنواع الاستخدامات ، وهم أكثر انفتاحًا على التقديمات.

الاخرون

هناك المزيد من المساعدين الصوتيين ، مثل Bixby من Samsung ، و Cortana من Microsoft ، والمساعد الصوتي الشهير مفتوح المصدر Mycroft. الثلاثة لديهم أتباع معقول ، لكنهم لا يزالون أقلية مقارنة بثلاثة جالاث من أمازون وجوجل وآبل.

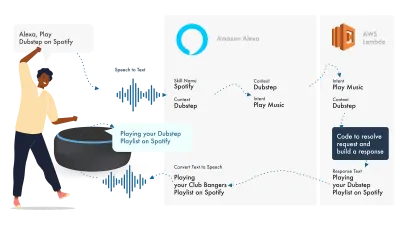

بناء على أمازون أليكسا

لقد تطور نظام Amazons Ecosystem للصوت للسماح للمطورين ببناء جميع مهاراتهم داخل وحدة تحكم Alexa ، لذا كمثال بسيط ، سأستخدم ميزاته المدمجة.

تتعامل Alexa مع معالجة اللغة الطبيعية ثم تجد النية المناسبة ، والتي يتم تمريرها إلى وظيفة Lambda الخاصة بنا للتعامل مع المنطق. يؤدي هذا إلى إرجاع بعض أجزاء المحادثة (SSML ، والنصوص ، والبطاقات ، وما إلى ذلك) إلى Alexa ، والتي تحول تلك البتات إلى ملفات صوتية ومرئية لتظهر على الجهاز.

يعد العمل على Amazon أمرًا بسيطًا نسبيًا ، حيث يتيح لك إنشاء جميع أجزاء مهارتك داخل Alexa Developer Console. تتوفر المرونة لاستخدام AWS أو نقطة نهاية HTTPS ، ولكن بالنسبة للمهارات البسيطة ، يجب أن يكون تشغيل كل شيء داخل وحدة تحكم Dev كافياً.

دعونا نبني مهارة بسيطة من مهارات اليكسا

توجه إلى وحدة تحكم Amazon Alexa ، وأنشئ حسابًا إذا لم يكن لديك حساب ، وقم بتسجيل الدخول ،

انقر فوق Create Skill ثم قم بتسميتها ،

اختر نموذجًا custom لك ،

واختر Alexa-Hosted (Node.js) لمورد الواجهة الخلفية.

بمجرد الانتهاء من التزويد ، سيكون لديك مهارة أساسية من Alexa ، وستكون نيتك مصممة لك ، وبعض التعليمات البرمجية الخلفية لتبدأ.

إذا نقرت على HelloWorldIntent في نواياك ، فسترى بعض نماذج الكلام التي تم إعدادها بالفعل من أجلك ، دعنا نضيف واحدة جديدة في الأعلى. تسمى مهارتنا hello world ، لذا أضف Hello World كنموذج لفظي. الفكرة هي التقاط أي شيء قد يقوله المستخدم لإثارة هذه النية. يمكن أن يكون هذا "Hi World" و "Howdy World" وما إلى ذلك.

ماذا يحدث في Fulfillment JS؟

إذن ماذا تفعل الكود؟ هذا هو الكود الافتراضي:

const HelloWorldIntentHandler = { canHandle(handlerInput) { return Alexa.getRequestType(handlerInput.requestEnvelope) === 'IntentRequest' && Alexa.getIntentName(handlerInput.requestEnvelope) === 'HelloWorldIntent'; }, handle(handlerInput) { const speakOutput = 'Hello World!'; return handlerInput.responseBuilder .speak(speakOutput) .getResponse(); } }; هذا باستخدام ask-sdk-core وهو أساسًا يقوم ببناء JSON لنا. canHandle بالسؤال عن إمكانية التعامل مع المقاصد ، وتحديداً "HelloWorldIntent". يأخذ handle المدخلات ويبني الاستجابة. ما يولده هذا يبدو كالتالي:

{ "body": { "version": "1.0", "response": { "outputSpeech": { "type": "SSML", "ssml": " Hello World! " }, "type": "_DEFAULT_RESPONSE" }, "sessionAttributes": {}, "userAgent": "ask-node/2.3.0 Node/v8.10.0" } }{ "body": { "version": "1.0", "response": { "outputSpeech": { "type": "SSML", "ssml": " Hello World! " }, "type": "_DEFAULT_RESPONSE" }, "sessionAttributes": {}, "userAgent": "ask-node/2.3.0 Node/v8.10.0" } }{ "body": { "version": "1.0", "response": { "outputSpeech": { "type": "SSML", "ssml": " Hello World! " }, "type": "_DEFAULT_RESPONSE" }, "sessionAttributes": {}, "userAgent": "ask-node/2.3.0 Node/v8.10.0" } }

يمكننا أن نرى أن speak مخرجات ssml في json الخاص بنا ، وهو ما سوف يسمعه المستخدم كما يتحدث به Alexa.

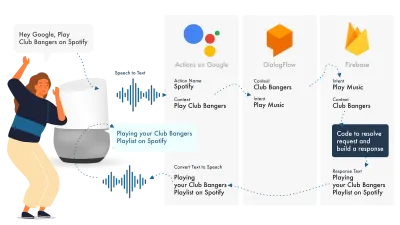

بناء لمساعد جوجل

إن أبسط طريقة لإنشاء Actions on Google هي استخدام وحدة تحكم AoG الخاصة بهم جنبًا إلى جنب مع Dialogflow ، يمكنك توسيع مهاراتك باستخدام Firebase ، ولكن كما هو الحال مع برنامج Amazon Alexa التعليمي ، دعنا نجعل الأمور بسيطة.

يستخدم Google Assistant ثلاثة أجزاء أساسية ، AoG ، التي تتعامل مع NLP ، و Dialogflow ، التي تحدد نواياك ، و Firebase ، التي تلبي الطلب ، وتنتج الاستجابة التي سيتم إرسالها مرة أخرى إلى AoG.

تمامًا كما هو الحال مع Alexa ، يتيح لك Dialogflow إنشاء وظائف مباشرة داخل النظام الأساسي.

دعونا نبني إجراءً على Google

هناك ثلاث منصات للتوفيق في وقت واحد مع حل Google ، والتي يمكن الوصول إليها من خلال ثلاث وحدات تحكم مختلفة ، لذا قم بالتبويب!

إعداد مسار الحوار

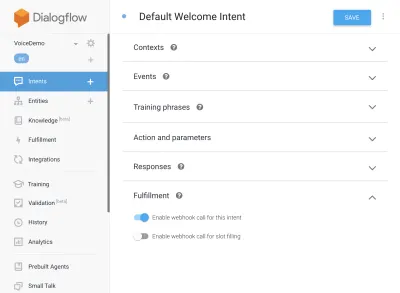

لنبدأ بتسجيل الدخول إلى وحدة تحكم Dialogflow. بمجرد تسجيل الدخول ، قم بإنشاء وكيل جديد من القائمة المنسدلة أسفل شعار Dialogflow.

امنح وكيلك اسمًا ، وأضفه إلى "القائمة المنسدلة لمشروع Google" ، مع تحديد "إنشاء مشروع Google جديد".

انقر فوق الزر "إنشاء" ، واتركه يقوم بسحره ، وسيستغرق الأمر بعض الوقت لإعداد الوكيل ، لذا كن صبورًا.

إعداد وظائف Firebase

حسنًا ، يمكننا الآن البدء في التعويض عن منطق الوفاء.

توجه إلى علامة التبويب Fulfillment. حدد لتمكين المحرر المضمن ، واستخدم مقتطفات JS أدناه:

index.js

'use strict'; // So that you have access to the dialogflow and conversation object const { dialogflow } = require('actions-on-google'); // So you have access to the request response stuff >> functions.https.onRequest(app) const functions = require('firebase-functions'); // Create an instance of dialogflow for your app const app = dialogflow({debug: true}); // Build an intent to be fulfilled by firebase, // the name is the name of the intent that dialogflow passes over app.intent('Default Welcome Intent', (conv) => { // Any extra logic goes here for the intent, before returning a response for firebase to deal with return conv.ask(`Welcome to a firebase fulfillment`); }); // Finally we export as dialogflowFirebaseFulfillment so the inline editor knows to use it exports.dialogflowFirebaseFulfillment = functions.https.onRequest(app);package.json

{ "name": "functions", "description": "Cloud Functions for Firebase", "scripts": { "lint": "eslint .", "serve": "firebase serve --only functions", "shell": "firebase functions:shell", "start": "npm run shell", "deploy": "firebase deploy --only functions", "logs": "firebase functions:log" }, "engines": { "node": "10" }, "dependencies": { "actions-on-google": "^2.12.0", "firebase-admin": "~7.0.0", "firebase-functions": "^3.3.0" }, "devDependencies": { "eslint": "^5.12.0", "eslint-plugin-promise": "^4.0.1", "firebase-functions-test": "^0.1.6" }, "private": true }عد الآن إلى نواياك ، وانتقل إلى Default Welcome Intent ، وانتقل لأسفل إلى التنفيذ ، وتأكد من تحديد "Enable webhook call for this intent" بحثًا عن أي نوايا ترغب في تحقيقها باستخدام جافا سكريبت. اضغط على حفظ.

إعداد AoG

نحن نقترب الآن من خط النهاية. توجه إلى علامة تبويب التكامل ، وانقر فوق إعدادات التكامل في خيار مساعد Google في الأعلى. سيؤدي هذا إلى فتح مشروط ، لذلك لننقر فوق اختبار ، والذي سيؤدي إلى دمج Dialogflow مع Google ، وفتح نافذة اختبار على الإجراءات على Google.

في نافذة الاختبار ، يمكننا النقر فوق التحدث إلى تطبيق الاختبار الخاص بي (سنقوم بتغيير هذا في ثانية) ، وفويلا ، لدينا رسالة من جافا سكريبت تظهر في اختبار مساعد جوجل.

يمكننا تغيير اسم المساعد في علامة التبويب "تطوير" في الأعلى.

إذن ما الذي يحدث في Fulfillment JS؟

أولاً ، نحن نستخدم حزمتين من حزم npm ، وهما Actions-on-google التي توفر كل الوفاء الذي يحتاجه كل من AoG و Dialogflow ، وثانيًا ، تحتوي وظائف firebase ، التي خمنتها ، على مساعدين لـ firebase.

ثم نقوم بإنشاء "التطبيق" وهو كائن يحتوي على جميع نوايانا.

كل نية يتم إنشاؤها تم تمريرها "تحويل" وهو كائن المحادثة الذي ترسله "الإجراءات على Google". يمكننا استخدام محتوى التحويل لاكتشاف معلومات حول التفاعلات السابقة مع المستخدم (مثل معرفهم ومعلومات حول جلستهم معنا).

نعيد "كائن conv.ask" ، والذي يحتوي على رسالة الإرجاع الخاصة بنا إلى المستخدم ، لتكون جاهزة للرد بقصد آخر. يمكننا استخدام "conv.close" لإنهاء المحادثة إذا أردنا إنهاء المحادثة هناك.

أخيرًا ، نختتم كل شيء في وظيفة Firebase HTTPS ، والتي تتعامل مع منطق الطلب والاستجابة من جانب الخادم بالنسبة لنا.

مرة أخرى ، إذا نظرنا إلى الاستجابة التي تم إنشاؤها:

{ "payload": { "google": { "expectUserResponse": true, "richResponse": { "items": [ { "simpleResponse": { "textToSpeech": "Welcome to a firebase fulfillment" } } ] } } } } يمكننا أن نرى أن conv.ask قد تم إدخال نصه في منطقة textToSpeech . إذا كنا قد اخترنا conv.close ، expectUserResponse تعيين "رد المستخدم المتوقع" على " false " وسيتم إغلاق المحادثة بعد تسليم الرسالة.

منشئي صوت الطرف الثالث

تمامًا مثل صناعة التطبيقات ، مع زيادة قوة الصوت ، بدأت أدوات الطرف الثالث في الظهور في محاولة لتخفيف العبء عن المطورين ، مما يسمح لهم بالبناء مرة واحدة مرتين.

تعد Jovo و Voiceflow حاليًا الأكثر شعبية ، خاصة منذ استحواذ Apple على PullString. تقدم كل منصة مستوى مختلفًا من التجريد ، لذلك يعتمد الأمر حقًا على مدى بساطة واجهتك.

توسيع مهارتك

الآن بعد أن فهمت بناء مهارة "Hello World" الأساسية ، هناك الكثير من الأجراس والصفارات التي يمكن إضافتها إلى مهارتك. هذه هي الكرز على رأس كعكة المساعدين الصوتيين وستمنح المستخدمين لديك الكثير من القيمة الإضافية ، مما يؤدي إلى تكرار العرف والفرص التجارية المحتملة.

SSML

ترمز SSML إلى لغة ترميز تركيب الكلام وتعمل ببنية مشابهة لـ HTML ، والفرق الرئيسي هو أنك تقوم ببناء استجابة منطوقة ، وليس محتوى على صفحة ويب.

يعتبر مصطلح "SSML" مضللًا بعض الشيء ، ويمكنه أن يفعل أكثر من مجرد تركيب الكلام! يمكنك الحصول على أصوات متوازية ، يمكنك تضمين ضوضاء الأجواء ، ورموز الكلام (تستحق الاستماع إليها في حد ذاتها ، والتفكير في الرموز التعبيرية للعبارات الشهيرة) ، والموسيقى.

متى يجب علي استخدام SSML؟

SSML رائع ؛ إنه يجعل تجربة أكثر جاذبية للمستخدم ، ولكن ما يفعله أيضًا هو تقليل مرونة إخراج الصوت. أوصي باستخدامه لمناطق الكلام الأكثر ثباتًا. يمكنك استخدام المتغيرات فيه للأسماء وما إلى ذلك ، ولكن ما لم تكن تنوي إنشاء منشئ SSML ، فإن معظم SSML ستكون ثابتة جدًا.

ابدأ بكلام بسيط في مهارتك ، وبمجرد اكتمالها ، قم بتحسين المناطق التي تكون أكثر ثباتًا مع SSML ، ولكن احصل على جوهرك مباشرة قبل الانتقال إلى الأجراس والصفارات. ومع ذلك ، يقول تقرير حديث أن 71٪ من المستخدمين يفضلون الصوت البشري (الحقيقي) على الصوت المركب ، لذلك إذا كان لديك التسهيلات للقيام بذلك ، فاخرج وافعل ذلك!

في مشتريات المهارة

تشبه عمليات الشراء التي تعتمد على المهارات (أو ISP) مفهوم عمليات الشراء داخل التطبيق. تميل المهارات إلى أن تكون مجانية ، لكن بعضها يسمح بشراء محتوى / اشتراكات "متميزة" داخل التطبيق ، ويمكن أن تعزز هذه تجربة المستخدم ، أو تفتح مستويات جديدة في الألعاب ، أو تسمح بالوصول إلى المحتوى المحمي بنظام حظر الاشتراك غير المدفوع.

متعدد الوسائط

تغطي الاستجابات متعددة الوسائط أكثر بكثير من الصوت ، وهذا هو المكان الذي يمكن أن يتألق فيه المساعدون الصوتيون حقًا مع المرئيات التكميلية على الأجهزة التي تدعمهم. إن تعريف التجارب متعددة الوسائط أوسع بكثير ويعني بشكل أساسي إدخالات متعددة (لوحة المفاتيح والماوس وشاشة اللمس والصوت وما إلى ذلك).

تهدف المهارات متعددة الوسائط إلى استكمال تجربة الصوت الأساسية ، وتوفير معلومات تكميلية إضافية لتعزيز تجربة المستخدم. عند بناء تجربة وسائط متعددة ، تذكر أن الصوت هو الناقل الأساسي للمعلومات. لا تحتوي العديد من الأجهزة على شاشة ، لذلك لا تزال مهارتك بحاجة إلى العمل بدون شاشة ، لذا تأكد من الاختبار باستخدام أنواع أجهزة متعددة ؛ سواء كان حقيقيًا أو في جهاز محاكاة.

متعدد اللغات

المهارات متعددة اللغات هي مهارات تعمل بلغات متعددة وتفتح مهاراتك في أسواق متعددة.

يرجع تعقيد جعل مهارتك متعددة اللغات إلى مدى ديناميكية ردودك. المهارات ذات الاستجابات الثابتة نسبيًا ، على سبيل المثال إعادة نفس العبارة في كل مرة ، أو فقط باستخدام مجموعة صغيرة من العبارات ، أسهل بكثير في جعلها متعددة اللغات من المهارات الديناميكية المترامية الأطراف.

الحيلة مع متعدد اللغات هي أن يكون لديك شريك ترجمة جدير بالثقة ، سواء كان ذلك من خلال وكالة أو مترجم على Fiverr. يجب أن تكون قادرًا على الوثوق في الترجمات المقدمة ، خاصةً إذا كنت لا تفهم اللغة التي تتم الترجمة إليها. ترجمة جوجل لن تقطع الخردل هنا!

خاتمة

إذا كان هناك وقت للدخول في صناعة الصوت ، فسيكون الآن. في بدايتها وطفولتها ، بالإضافة إلى التسعة الكبار ، يستثمرون المليارات في زراعته وجلب المساعدين الصوتيين إلى منازل الجميع وفي الروتين اليومي.

قد يكون اختيار النظام الأساسي الذي تريد استخدامه أمرًا صعبًا ، ولكن بناءً على ما تنوي بنائه ، يجب أن تتألق المنصة التي ستستخدمها ، أو إذا فشلت في ذلك ، استخدم أداة طرف ثالث للتحوط من رهاناتك والبناء على منصات متعددة ، خاصة إذا كانت مهارتك أقل تعقيدًا مع عدد أقل من الأجزاء المتحركة.

أنا ، على سبيل المثال ، أنا متحمس لمستقبل الصوت عندما يصبح في كل مكان ؛ سيقل الاعتماد على الشاشة وسيتمكن العملاء من التفاعل بشكل طبيعي مع مساعدهم. لكن أولاً ، الأمر متروك لنا لبناء المهارات التي يريدها الأشخاص من مساعديهم.