المزج الملموس وغير الملموس: تصميم واجهات متعددة الوسائط باستخدام Adobe XD

نشرت: 2022-03-10(تفضل Adobe برعاية هذه المقالة.) تتطور واجهات المستخدم. تتحدى الواجهات التي تدعم الصوت الهيمنة الطويلة لواجهات المستخدم الرسومية وأصبحت بسرعة جزءًا مشتركًا من حياتنا اليومية. لقد أثر التقدم الملحوظ في التعرف التلقائي على الكلام (APS) ومعالجة اللغة الطبيعية (NLP) ، جنبًا إلى جنب مع قاعدة عملاء رائعة (ملايين الأجهزة المحمولة المزودة بمساعدين صوتيين مدمجين) ، على التطور السريع واعتماد الواجهة القائمة على الصوت.

أصبحت المنتجات التي تستخدم الصوت كواجهة أساسية أكثر شيوعًا. في الولايات المتحدة وحدها ، 47.3 مليون بالغ يمكنهم الوصول إلى مكبر صوت ذكي (أي خمس السكان البالغين في الولايات المتحدة) ، والعدد آخذ في الازدياد. لكن واجهات الصوت لها مستقبل مشرق ليس فقط في الاستخدام الشخصي والمنزلي. عندما يعتاد الناس على الواجهات الصوتية ، فإنهم يتوقعونها في سياق الأعمال أيضًا. فقط تخيل أنك ستتمكن قريبًا من تشغيل جهاز عرض بغرفة المؤتمرات بقول شيء مثل ، "اعرض عرضي التقديمي".

من الواضح أن التواصل بين الإنسان والآلة يتوسع بسرعة ليشمل التفاعل الكتابي والمنطوق. لكن هل يعني ذلك أن واجهات المستقبل ستكون صوت فقط؟ على الرغم من بعض صور الخيال العلمي ، لن يحل الصوت محل واجهات المستخدم الرسومية تمامًا. بدلاً من ذلك ، سيكون لدينا تآزر بين الصوت والمرئيات والإيماءات في تنسيق جديد للواجهة: واجهة متعددة الوسائط تدعم الصوت.

في هذه المقالة ، سنقوم بما يلي:

- استكشاف مفهوم الواجهة التي تدعم الصوت ومراجعة أنواع مختلفة من الواجهات التي تدعم الصوت ؛

- اكتشف لماذا ستكون واجهات المستخدم متعددة الوسائط والممكّنة بالصوت هي تجربة المستخدم المفضلة ؛

- تعرف على كيفية إنشاء واجهة مستخدم متعددة الوسائط باستخدام Adobe XD.

حالة واجهات المستخدم الصوتية (VUI)

قبل الغوص في تفاصيل واجهات المستخدم الصوتية ، يجب أن نحدد ماهية الإدخال الصوتي. الإدخال الصوتي هو تفاعل بين الإنسان والحاسوب حيث ينطق المستخدم الأوامر بدلاً من كتابتها. يكمن جمال الإدخال الصوتي في أنه تفاعل طبيعي أكثر للأشخاص - لا يقتصر المستخدمون على بناء جملة معين عند التفاعل مع نظام ؛ يمكنهم هيكلة مدخلاتهم بعدة طرق مختلفة ، تمامًا كما يفعلون في المحادثة البشرية.

توفر واجهات مستخدم الصوت الفوائد التالية لمستخدميها:

- تكلفة تفاعل أقل

على الرغم من أن استخدام واجهة ممكّنة للصوت يتضمن تكلفة تفاعل ، إلا أن هذه التكلفة أقل (نظريًا) من تكلفة تعلم واجهة مستخدم رسومية جديدة. - تحكم بدون استخدام اليدين

تعد VUIs رائعة عندما تكون أيدي المستخدمين مشغولة - على سبيل المثال ، أثناء القيادة أو الطهي أو التمرين. - سرعة

الصوت ممتاز عند طرح سؤال ما أسرع من كتابته وقراءة النتائج. على سبيل المثال ، عند استخدام الصوت في السيارة ، يكون من الأسرع قول المكان لنظام الملاحة ، بدلاً من كتابة الموقع على شاشة تعمل باللمس. - العاطفة والشخصية

حتى عندما نسمع صوتًا ولكن لا نرى صورة للمتحدث ، يمكننا تصوير المتحدث في رؤوسنا. هذا لديه فرصة لتحسين مشاركة المستخدم. - إمكانية الوصول

يمكن للمستخدمين المعاقين بصريًا والمستخدمين الذين يعانون من إعاقة حركية استخدام الصوت للتفاعل مع النظام.

ثلاثة أنواع من الواجهات التي تدعم الصوت

اعتمادًا على كيفية استخدام الصوت ، يمكن أن يكون أحد أنواع الواجهات التالية.

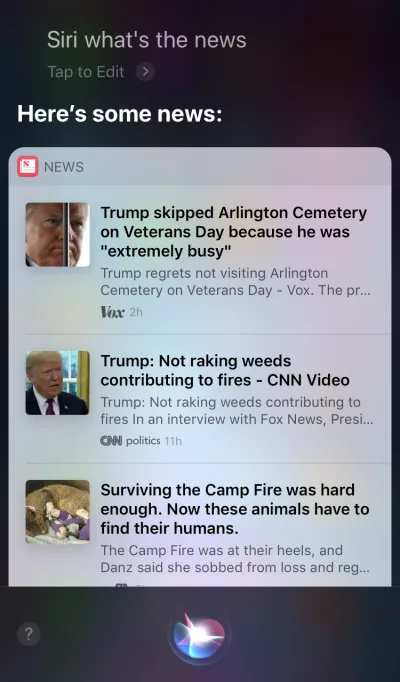

وكلاء الصوت في أجهزة Screen-First

يعد Apple Siri و Google Assistant مثالين رئيسيين لوكلاء الصوت. بالنسبة لمثل هذه الأنظمة ، يعمل الصوت مثل تحسين واجهة المستخدم الرسومية الحالية. في كثير من الحالات ، يعمل الوكيل كخطوة أولى في رحلة المستخدم: يقوم المستخدم بتشغيل وكيل الصوت ويقدم أمرًا عبر الصوت ، بينما تتم جميع التفاعلات الأخرى باستخدام شاشة اللمس. على سبيل المثال ، عندما تطرح سؤالاً على Siri ، سيوفر لك إجابات بتنسيق قائمة ، وتحتاج إلى التفاعل مع تلك القائمة. نتيجة لذلك ، تصبح تجربة المستخدم مجزأة - نستخدم الصوت لبدء التفاعل ثم ننتقل إلى اللمس لمواصلة ذلك.

أجهزة الصوت فقط

لا تحتوي هذه الأجهزة على شاشات عرض مرئية ؛ يعتمد المستخدمون على الصوت لكل من الإدخال والإخراج. تعد مكبرات الصوت الذكية Amazon Echo و Google Home من الأمثلة الرئيسية للمنتجات في هذه الفئة. يعد عدم وجود شاشة عرض مرئية قيدًا كبيرًا على قدرة الجهاز على توصيل المعلومات والخيارات للمستخدم. نتيجة لذلك ، يستخدم معظم الأشخاص هذه الأجهزة لإكمال المهام البسيطة ، مثل تشغيل الموسيقى والحصول على إجابات لأسئلة بسيطة.

أجهزة Voice-First

مع أنظمة الصوت أولاً ، يقبل الجهاز إدخال المستخدم بشكل أساسي عبر الأوامر الصوتية ، ولكن يحتوي أيضًا على شاشة عرض مدمجة. هذا يعني أن الصوت هو واجهة المستخدم الأساسية ، ولكنه ليس الواجهة الوحيدة. لا يزال القول المأثور "الصورة تساوي ألف كلمة" ينطبق على الأنظمة الحديثة التي تدعم الصوت. يمتلك الدماغ البشري صورة مذهلة - قدرات معالجة - يمكننا فهم المعلومات المعقدة بشكل أسرع عندما نراها بصريًا. بالمقارنة مع الأجهزة الصوتية فقط ، تسمح الأجهزة التي تعتمد على الصوت أولاً للمستخدمين بالوصول إلى كمية أكبر من المعلومات وتسهيل العديد من المهام.

يعد Amazon Echo Show مثالًا رئيسيًا على جهاز يستخدم نظام الصوت أولاً. يتم دمج المعلومات المرئية تدريجيًا كجزء من نظام شامل - لا يتم تحميل الشاشة بأيقونات التطبيقات ؛ بدلاً من ذلك ، يشجع النظام المستخدمين على تجربة أوامر صوتية مختلفة (اقتراح أوامر شفهية مثل ، "جرب" Alexa ، أرني الطقس في الساعة 5:00 مساءً "). حتى أن الشاشة تجعل المهام الشائعة مثل التحقق من الوصفة أثناء الطهي أسهل بكثير - لا يحتاج المستخدمون إلى الاستماع بعناية والاحتفاظ بجميع المعلومات في رؤوسهم ؛ عندما يحتاجون إلى المعلومات ، فإنهم ببساطة ينظرون إلى الشاشة.

إدخال واجهات الوسائط المتعددة

عندما يتعلق الأمر باستخدام الصوت في تصميم واجهة المستخدم ، فلا تفكر في الصوت على أنه شيء يمكنك استخدامه بمفردك. تشتمل الأجهزة مثل Amazon Echo Show على شاشة ولكنها تستخدم الصوت كطريقة إدخال أساسية ، مما يجعل تجربة المستخدم أكثر شمولية. هذه هي الخطوة الأولى نحو جيل جديد من واجهات المستخدم: واجهات متعددة الوسائط.

الواجهة متعددة الوسائط هي واجهة تمزج بين الصوت واللمس والصوت وأنواع مختلفة من المرئيات في واجهة مستخدم واحدة سلسة. يعد Amazon Echo Show مثالاً ممتازًا على جهاز يستفيد استفادة كاملة من واجهة الوسائط المتعددة التي تدعم الصوت. عندما يتفاعل المستخدمون مع Show ، فإنهم يقدمون طلبات تمامًا كما يفعلون مع جهاز صوتي فقط ؛ ومع ذلك ، فإن الاستجابة التي يتلقونها ستكون على الأرجح متعددة الوسائط ، تحتوي على استجابات صوتية ومرئية.

تعد المنتجات متعددة الوسائط أكثر تعقيدًا من المنتجات التي تعتمد فقط على العناصر المرئية أو الصوت فقط. لماذا يجب على أي شخص إنشاء واجهة متعددة الوسائط في المقام الأول؟ للإجابة على هذا السؤال ، نحتاج إلى التراجع ونرى كيف ينظر الناس إلى البيئة من حولهم. الناس لديهم خمس حواس ، ومزيج من حواسنا التي تعمل معًا هو كيفية إدراكنا للأشياء. على سبيل المثال ، تعمل حواسنا معًا عندما نستمع إلى الموسيقى في حفل موسيقي مباشر. أزل حاسة واحدة (على سبيل المثال ، السمع) ، وتأخذ التجربة سياقًا مختلفًا تمامًا.

لوقت طويل ، فكرنا في تجربة المستخدم على أنها تصميم مرئي أو إيمائي حصري. حان الوقت لتغيير هذا التفكير. التصميم متعدد الوسائط هو طريقة للتفكير والتصميم للخبرات التي تربط قدراتنا الحسية معًا.

تبدو الواجهات متعددة الوسائط وكأنها طريقة أكثر إنسانية للتواصل بين المستخدم والآلة. إنهم يفتحون فرصًا جديدة لتفاعلات أعمق. واليوم ، أصبح تصميم واجهات متعددة الوسائط أسهل بكثير لأن القيود التقنية التي كانت في الماضي قيدت التفاعلات مع المنتجات يتم محوها.

الفرق بين واجهة المستخدم الرسومية والواجهة متعددة الوسائط

يتمثل الاختلاف الرئيسي هنا في أن الواجهات متعددة الوسائط مثل Amazon Echo Show تقوم بمزامنة الصوت والواجهات المرئية. نتيجة لذلك ، عندما نصمم التجربة ، لم يعد الصوت والمرئيات أجزاء مستقلة ؛ فهي جزء لا يتجزأ من التجربة التي يوفرها النظام.

القناة المرئية والصوتية: متى تستخدم كل منها

من المهم التفكير في الصوت والمرئيات كقنوات للإدخال والإخراج. كل قناة لها نقاط قوتها وضعفها.

لنبدأ بالصور. من الواضح أن بعض المعلومات يسهل فهمها عندما نراها ، وليس عندما نسمعها. تعمل المرئيات بشكل أفضل عندما تحتاج إلى تقديم:

- قائمة طويلة من الخيارات (سوف تستغرق قراءة قائمة طويلة الكثير من الوقت ويصعب متابعتها) ؛

- معلومات ثقيلة البيانات (مثل الرسوم البيانية والرسوم البيانية) ؛

- معلومات المنتج (على سبيل المثال ، المنتجات في المتاجر عبر الإنترنت ؛ على الأرجح ، قد ترغب في رؤية منتج قبل الشراء) ومقارنة المنتج (كما هو الحال مع القائمة الطويلة من الخيارات ، سيكون من الصعب توفير جميع المعلومات باستخدام الصوت فقط) .

بالنسبة لبعض المعلومات ، يمكننا بسهولة الاعتماد على التواصل اللفظي. قد يكون الصوت مناسبًا للحالات التالية:

- أوامر المستخدم (الصوت هو طريقة إدخال فعالة ، تسمح للمستخدمين بإعطاء أوامر للنظام بسرعة وتجاوز قوائم التنقل المعقدة) ؛

- تعليمات بسيطة للمستخدم (على سبيل المثال ، فحص روتيني لوصفة طبية) ؛

- التحذيرات والإشعارات (على سبيل المثال ، تحذير صوتي مقترن بإشعارات صوتية أثناء القيادة).

في حين أن هذه بعض الحالات النموذجية للمجموعة المرئية والصوتية ، فمن المهم أن نعرف أنه لا يمكننا فصل الاثنين عن بعضنا البعض. لا يمكننا إنشاء تجربة مستخدم أفضل إلا عندما يعمل الصوت والمرئيات معًا. على سبيل المثال ، افترض أننا نريد شراء زوج جديد من الأحذية. يمكننا استخدام الصوت لطلب من النظام ، "Show me New Balance shoes". سيقوم النظام بمعالجة طلبك وتقديم معلومات المنتج بشكل مرئي (طريقة أسهل بالنسبة لنا لمقارنة الأحذية).

ما تحتاج إلى معرفته لتصميم واجهات ممكّنة بالصوت ومتعددة الوسائط

يعد Voice أحد أكثر التحديات إثارة لمصممي UX. على الرغم من حداثته ، فإن القواعد الأساسية لتصميم واجهة متعددة الوسائط تدعم الصوت هي نفسها التي نستخدمها لإنشاء تصميمات مرئية. يجب أن يهتم المصممون بمستخدميهم. يجب أن تهدف إلى تقليل الاحتكاك للمستخدم من خلال حل مشاكلهم بطرق فعالة وتحديد أولويات الوضوح لتوضيح خيارات المستخدم.

ولكن هناك بعض مبادئ التصميم الفريدة للواجهات متعددة الوسائط أيضًا.

تأكد من حل المشكلة الصحيحة

يجب أن يحل التصميم المشاكل. لكن من الضروري حل المشكلات الصحيحة ؛ بخلاف ذلك ، يمكنك قضاء الكثير من الوقت في إنشاء تجربة لا تحقق الكثير من القيمة للمستخدمين. وبالتالي ، تأكد من أنك تركز على حل المشكلة الصحيحة. يجب أن تكون التفاعلات الصوتية منطقية للمستخدم ؛ يجب أن يكون لدى المستخدمين سبب مقنع لاستخدام الصوت فوق طرق التفاعل الأخرى (مثل النقر أو النقر). لهذا السبب ، عند إنشاء منتج جديد - حتى قبل بدء التصميم - من الضروري إجراء بحث للمستخدم وتحديد ما إذا كان الصوت سيحسن تجربة المستخدم.

ابدأ بإنشاء خريطة رحلة المستخدم. قم بتحليل خريطة الرحلة وابحث عن الأماكن التي يفيد فيها تضمين الصوت كقناة تجربة المستخدم.

- ابحث عن أماكن في الرحلة قد يواجه فيها المستخدمون الاحتكاك والإحباط. هل استخدام الصوت يقلل الاحتكاك؟

- فكر في سياق المستخدم. هل سيعمل الصوت في سياق معين؟

- فكر فيما يتم تمكينه بشكل فريد عن طريق الصوت. تذكر الفوائد الفريدة لاستخدام الصوت ، مثل التفاعل بدون استخدام اليدين وبدون استخدام العيون. هل يمكن أن يضيف الصوت قيمة إلى التجربة؟

إنشاء تدفقات المحادثة

من الناحية المثالية ، يجب أن تتطلب الواجهات التي تصممها تكلفة تفاعل صفرية: يجب أن يكون المستخدمون قادرين على تلبية احتياجاتهم دون قضاء وقت إضافي في تعلم كيفية التفاعل مع النظام. يحدث هذا فقط عندما يشبه التفاعل الصوتي محادثة حقيقية ، وليس حوار نظام ملفوفًا بتنسيق أوامر صوتية. القاعدة الأساسية لواجهة مستخدم جيدة بسيطة: يجب أن تتكيف أجهزة الكمبيوتر مع البشر ، وليس العكس.

نادرًا ما يكون لدى الأشخاص محادثات خطية مسطحة (المحادثات التي لا تستغرق سوى دورة واحدة). لهذا السبب ، لجعل التفاعل مع نظام يبدو وكأنه محادثة مباشرة ، يجب على المصممين التركيز على إنشاء تدفقات محادثة. يتكون كل تدفق محادثة من مربعات حوار - المسارات التي تحدث بين النظام والمستخدم. سيتضمن كل حوار مطالبات النظام وردود المستخدم المحتملة.

يمكن تقديم تدفق المحادثة في شكل مخطط تدفق. يجب أن يركز كل تدفق على حالة استخدام معينة (على سبيل المثال ، ضبط المنبه باستخدام نظام). بالنسبة لمعظم مربعات الحوار في التدفق ، من الضروري مراعاة مسارات الخطأ ، عندما تنفصل الأشياء عن المسار.

يتكون كل أمر صوتي للمستخدم من ثلاثة عناصر أساسية: القصد والكلام والفتحة.

- النية هي الهدف من تفاعل المستخدم مع نظام يدعم الصوت.

النية هي مجرد طريقة خيالية لتحديد الغرض من وراء مجموعة من الكلمات. كل تفاعل مع نظام يجلب للمستخدم بعض الفوائد. سواء كانت معلومات أو إجراء ، فإن الأداة في النية. يعد فهم نية المستخدم جزءًا مهمًا من الواجهات التي تدعم الصوت. عندما نصمم واجهة المستخدم الرسومية (VUI) ، فإننا لا نعرف دائمًا على وجه اليقين ما هي نية المستخدم ، ولكن يمكننا تخمينها بدقة عالية. - الكلام هو كيف يعبر المستخدم عن طلبه.

عادة ، يكون لدى المستخدمين أكثر من طريقة لصياغة أمر صوتي. على سبيل المثال ، يمكننا ضبط المنبه بقول "ضبط المنبه على الساعة 8 صباحًا" أو "المنبه الساعة 8 صباحًا غدًا" أو حتى "أريد الاستيقاظ في الساعة 8 صباحًا". يحتاج المصممون إلى النظر في كل اختلاف ممكن في الكلام. - الفتحات هي متغيرات يستخدمها المستخدمون في الأمر. يحتاج المستخدمون أحيانًا إلى تقديم معلومات إضافية في الطلب. في مثالنا على المنبه ، "8 صباحًا" هي فتحة.

لا تضع الكلمات في فم المستخدم

يعرف الناس كيف يتحدثون. لا تحاول تعليمهم الأوامر. تجنب عبارات مثل ، "لإرسال موعد اجتماع ، عليك أن تقول" التقويم ، الاجتماعات ، إنشاء اجتماع جديد ". إذا كان عليك شرح الأوامر ، فأنت بحاجة إلى إعادة النظر في الطريقة التي تصمم بها النظام. تهدف دائمًا إلى محادثة لغة طبيعية ، وحاول استيعاب أساليب التحدث المتنوعة).

اسعَ لتحقيق الاتساق

تحتاج إلى تحقيق الاتساق في اللغة والصوت عبر السياقات. سيساعد الاتساق في بناء الألفة في التفاعلات.

قدم ملاحظاتك دائمًا

تعد رؤية حالة النظام أحد المبادئ الأساسية لتصميم واجهة المستخدم الرسومية الجيد. يجب أن يُبقي النظام المستخدمين دائمًا على اطلاع بما يجري من خلال التعليقات المناسبة في غضون فترة زمنية معقولة. تنطبق نفس القاعدة على تصميم VUI.

- اجعل المستخدم يدرك أن النظام يستمع.

إظهار المؤشرات المرئية عندما يستمع الجهاز أو يعالج طلب المستخدم. بدون ملاحظات ، يمكن للمستخدم فقط تخمين ما إذا كان النظام يقوم بشيء ما. لهذا السبب تقدم لنا حتى الأجهزة الصوتية فقط مثل Amazon Echo و Google Home ملاحظات مرئية لطيفة (أضواء وامضة) عندما يستمعون أو يبحثون عن إجابة. - قدم علامات المحادثة.

تخبر محددات المحادثة المستخدم عن مكانهم في المحادثة. - قم بالتأكيد عند اكتمال المهمة.

على سبيل المثال ، عندما يطلب المستخدمون من نظام المنزل الذكي المزود بالصوت "إطفاء الأنوار في المرآب" ، يجب أن يُعلم النظام المستخدم أنه تم تنفيذ الأمر بنجاح. بدون تأكيد ، سيحتاج المستخدمون إلى السير في المرآب وفحص الأضواء. إنه يتعارض مع الغرض من نظام المنزل الذكي ، وهو جعل حياة المستخدم أسهل.

تجنب الجمل الطويلة

عند تصميم نظام يدعم الصوت ، ضع في اعتبارك الطريقة التي توفر بها المعلومات للمستخدمين. من السهل نسبيًا إرهاق المستخدمين بالكثير من المعلومات عند استخدام جمل طويلة. أولاً ، لا يمكن للمستخدمين الاحتفاظ بالكثير من المعلومات في ذاكرتهم قصيرة المدى ، لذلك يمكنهم بسهولة نسيان بعض المعلومات المهمة. أيضًا ، يعد الصوت وسيطًا بطيئًا - يمكن لمعظم الناس القراءة أسرع بكثير مما يمكنهم الاستماع.

كن محترمًا لوقت المستخدم الخاص بك ؛ لا تقرأ مونولوجات صوتية طويلة. عندما تصمم استجابة ، كلما قل عدد الكلمات التي تستخدمها ، كان ذلك أفضل. لكن تذكر أنك لا تزال بحاجة إلى تقديم معلومات كافية للمستخدم لإكمال مهمته. وبالتالي ، إذا لم تتمكن من تلخيص إجابة في بضع كلمات ، فقم بعرضها على الشاشة بدلاً من ذلك.

قدم الخطوات التالية بالتتابع

يمكن أن يشعر المستخدمون بالارتباك ليس فقط من خلال الجمل الطويلة ، ولكن أيضًا بعدد خياراتهم في وقت واحد. من الضروري تقسيم عملية التفاعل مع نظام يدعم الصوت إلى أجزاء صغيرة الحجم. حدد عدد الاختيارات التي يمتلكها المستخدم في أي وقت ، وتأكد من أنهم يعرفون ما يجب عليهم فعله في كل لحظة.

عند تصميم نظام معقد يدعم الصوت به الكثير من الميزات ، يمكنك استخدام تقنية الكشف التدريجي: قدم فقط الخيارات أو المعلومات اللازمة لإكمال المهمة.

امتلك إستراتيجية قوية لمعالجة الأخطاء

بالطبع ، يجب أن يمنع النظام حدوث الأخطاء في المقام الأول. ولكن بغض النظر عن مدى جودة نظامك الذي يدعم الصوت ، يجب عليك دائمًا تصميم السيناريو الذي لا يفهم فيه النظام المستخدم. مسؤوليتك هي التصميم لمثل هذه الحالات.

فيما يلي بعض النصائح العملية لإنشاء استراتيجية:

- لا تلوم المستخدم.

في المحادثة ، لا توجد أخطاء. حاول تجنب ردود مثل ، "إجابتك غير صحيحة." - توفير تدفقات استرداد الأخطاء.

وفر خيارًا للخلف والخلف في محادثة ، أو حتى للخروج من النظام ، دون فقدان معلومات مهمة. احفظ حالة المستخدم في الرحلة ، حتى يتمكن من إعادة التعامل مع النظام من حيث توقف. - السماح للمستخدمين بإعادة المعلومات.

وفر خيارًا لجعل النظام يكرر السؤال أو الإجابة. قد يكون هذا مفيدًا للأسئلة أو الإجابات المعقدة حيث يصعب على المستخدم الالتزام بجميع المعلومات في ذاكرته العاملة. - توفير صيغة التوقف.

في بعض الحالات ، لن يهتم المستخدم بالاستماع إلى خيار ما وسيرغب في أن يتوقف النظام عن الحديث عنه. يجب أن يساعدهم التوقف عن الصياغة على فعل ذلك. - تعامل مع الأقوال غير المتوقعة برشاقة.

بغض النظر عن المبلغ الذي تستثمره في تصميم النظام ، ستكون هناك مواقف لا يفهم فيها النظام المستخدم. من الضروري التعامل مع مثل هذه الحالات بأمان. لا تخف من السماح للنظام بالاعتراف بنقص الفهم. يجب أن ينقل النظام ما فهمه ويقدم مراجع مفيدة. - استخدم التحليلات لتحسين استراتيجية الخطأ الخاصة بك.

يمكن أن تساعدك التحليلات في تحديد المنعطفات الخاطئة والتفسيرات الخاطئة.

تتبع السياق

تأكد من أن النظام يفهم سياق إدخال المستخدم. على سبيل المثال ، عندما يقول أحدهم إنه يريد حجز رحلة إلى سان فرانسيسكو الأسبوع المقبل ، فقد يشير إلى "هي" أو "المدينة" أثناء تدفق المحادثة. يجب أن يتذكر النظام ما قيل وأن يكون قادرًا على مطابقته مع المعلومات المستلمة حديثًا.

تعرف على معلومات حول المستخدمين لديك لإنشاء تفاعلات أكثر قوة

يصبح النظام الذي يدعم الصوت أكثر تعقيدًا عندما يستخدم معلومات إضافية (مثل سياق المستخدم أو السلوك السابق) لفهم ما يريده المستخدم. تسمى هذه التقنية التفسير الذكي ، وتتطلب أن يتعرف النظام بنشاط على المستخدم وأن يكون قادرًا على ضبط سلوكه وفقًا لذلك. ستساعد هذه المعرفة النظام على تقديم إجابات حتى على الأسئلة المعقدة ، مثل "ما الهدية التي يجب أن أشتريها لعيد ميلاد زوجتي؟"

امنح VUI الخاص بك شخصية

كل نظام يدعم الصوت له تأثير عاطفي على المستخدم ، سواء كنت تخطط له أم لا. يربط الناس الصوت بالبشر بدلاً من الآلات. وفقًا لبحث Speak Easy Global Edition ، يتوقع 74٪ من المستخدمين المنتظمين لتقنية الصوت أن تتمتع العلامات التجارية بأصوات وشخصيات فريدة لمنتجاتها التي تدعم الصوت. من الممكن بناء التعاطف من خلال الشخصية وتحقيق مستوى أعلى من تفاعل المستخدم.

حاول أن تعكس علامتك التجارية وهويتك الفريدة في الصوت والنبرة التي تقدمها. قم ببناء شخصية وكيلك الممكّن صوتيًا ، واعتمد على هذه الشخصية عند إنشاء الحوارات.

بناء الثقة

عندما لا يثق المستخدمون في نظام ما ، فليس لديهم الدافع لاستخدامه. هذا هو السبب في أن بناء الثقة هو مطلب من متطلبات تصميم المنتج. هناك عاملان لهما تأثير كبير على مستوى الثقة المبنية: قدرات النظام والنتيجة الصحيحة.

يبدأ بناء الثقة بتحديد توقعات المستخدم. تحتوي واجهات المستخدم الرسومية التقليدية على الكثير من التفاصيل المرئية لمساعدة المستخدم على فهم ما يمكن للنظام أن يفعله. مع النظام الذي يدعم الصوت ، يكون لدى المصممين أدوات أقل للاعتماد عليها. ومع ذلك ، من الضروري جعل النظام قابلاً للاكتشاف بشكل طبيعي ؛ يجب أن يفهم المستخدم ما هو ممكن وما هو غير ممكن مع النظام. هذا هو السبب في أن النظام الذي يدعم الصوت قد يتطلب تأهيل المستخدم ، حيث يتحدث عن ما يمكن أن يفعله النظام أو ما يعرفه. عند تصميم الإعداد ، حاول تقديم أمثلة ذات مغزى للسماح للأشخاص بمعرفة ما يمكنهم فعله (الأمثلة تعمل بشكل أفضل من الإرشادات).

عندما يتعلق الأمر بنتائج صحيحة ، يعرف الناس أن الأنظمة التي تدعم الصوت غير كاملة. عندما يقدم النظام إجابة ، قد يشك بعض المستخدمين في صحة الإجابة. يحدث هذا لأن المستخدمين ليس لديهم أي معلومات حول ما إذا كان قد تم فهم طلبهم بشكل صحيح أو ما هي الخوارزمية المستخدمة للعثور على الإجابة. لمنع مشكلات الثقة ، استخدم الشاشة لدعم الأدلة - اعرض الاستعلام الأصلي على الشاشة - وقدم بعض المعلومات الأساسية حول الخوارزمية. على سبيل المثال ، عندما يسأل المستخدم ، "اعرض لي أفضل خمسة أفلام لعام 2018" ، يمكن للنظام أن يقول ، "إليك أفضل خمسة أفلام لعام 2018 وفقًا لشباك التذاكر في الولايات المتحدة".

لا تتجاهل الأمان وخصوصية البيانات

على عكس الأجهزة المحمولة ، التي تخص الفرد ، تميل الأجهزة الصوتية إلى الانتماء إلى موقع ، مثل المطبخ. وعادة ما يكون هناك أكثر من شخص في نفس المكان. فقط تخيل أن شخصًا آخر يمكنه التفاعل مع نظام يمكنه الوصول إلى جميع بياناتك الشخصية. يمكن لبعض أنظمة VUI مثل Amazon Alexa و Google Assistant و Apple Siri التعرف على الأصوات الفردية ، مما يضيف طبقة من الأمان إلى النظام. ومع ذلك ، فإنه لا يضمن أن النظام سيكون قادرًا على التعرف على المستخدمين بناءً على توقيعهم الصوتي الفريد في 100٪ من الحالات.

يتحسن التعرف على الصوت باستمرار ، وسيكون من الصعب أو شبه المستحيل تقليد الصوت في المستقبل القريب. ومع ذلك ، في الواقع الحالي ، من الضروري توفير طبقة مصادقة إضافية لطمأنة المستخدم بأن بياناته آمنة. إذا قمت بتصميم تطبيق يعمل مع بيانات حساسة ، مثل المعلومات الصحية أو التفاصيل المصرفية ، فقد ترغب في تضمين خطوة مصادقة إضافية ، مثل كلمة المرور أو بصمة الإصبع أو التعرف على الوجه.

إجراء اختبار قابلية الاستخدام

يعد اختبار قابلية الاستخدام مطلبًا إلزاميًا لأي نظام. اختبر مبكرًا ، يجب أن يكون الاختبار في كثير من الأحيان قاعدة أساسية لعملية التصميم الخاصة بك. اجمع بيانات بحث المستخدم في وقت مبكر ، وكرر تصميماتك. لكن اختبار الواجهات متعددة الوسائط له خصائصه الخاصة. فيما يلي مرحلتان يجب مراعاتهما:

- مرحلة التفكير

اختبار قيادة نماذج الحوارات الخاصة بك. تدرب على قراءة نماذج الحوارات بصوت عالٍ. بمجرد حصولك على بعض تدفقات المحادثة ، قم بتسجيل جانبي المحادثة (أقوال المستخدم وردود النظام) ، واستمع إلى التسجيل لفهم ما إذا كانت تبدو طبيعية. - المراحل المبكرة من تطوير المنتج (الاختبار باستخدام نماذج Lo-fi)

يعد اختبار Wizard of Oz مناسبًا تمامًا لاختبار واجهات المحادثة. يعد اختبار Wizard of Oz نوعًا من الاختبارات يتفاعل فيه أحد المشاركين مع نظام يعتقد أنه يتم تشغيله بواسطة جهاز كمبيوتر ولكنه في الواقع يتم تشغيله بواسطة إنسان. يقوم المشارك في الاختبار بصياغة استعلام ، ويجيب شخص حقيقي على الطرف الآخر. حصلت هذه الطريقة على اسمها من كتاب The Wonderful Wizard of Oz بقلم فرانك بوم. في الكتاب ، يختبئ رجل عادي خلف ستارة ، متظاهرًا بأنه ساحر قوي. يسمح لك هذا الاختبار بتخطيط كل سيناريو محتمل للتفاعل ، ونتيجة لذلك ، إنشاء تفاعلات طبيعية أكثر. Say Wizard هو أداة رائعة لمساعدتك في تشغيل اختبار واجهة الصوت Wizard of Oz على macOS. - المراحل اللاحقة من تطوير المنتج (الاختبار باستخدام نماذج hi-fi الأولية)

في اختبار قابلية الاستخدام لواجهات المستخدم الرسومية ، غالبًا ما نطلب من المستخدمين التحدث بصوت عالٍ عند تفاعلهم مع نظام. بالنسبة للنظام الذي يدعم الصوت ، لا يكون هذا ممكنًا دائمًا لأن النظام سيستمع إلى هذا السرد. لذلك ، قد يكون من الأفضل مراقبة تفاعلات المستخدم مع النظام ، بدلاً من مطالبتهم بالتحدث بصوت عالٍ.

كيفية إنشاء واجهة متعددة الوسائط باستخدام Adobe XD

الآن بعد أن أصبح لديك فهم قوي لماهية الواجهة متعددة الوسائط والقواعد التي يجب تذكرها عند تصميمها ، يمكننا مناقشة كيفية إنشاء نموذج أولي لواجهة متعددة الوسائط.

النماذج الأولية هي جزء أساسي من عملية التصميم. من المهم للغاية أن تكون قادرًا على إحياء فكرة ومشاركتها مع الآخرين. حتى الآن ، كان لدى المصممين الذين أرادوا دمج الصوت في النماذج الأولية أدوات قليلة للاعتماد عليها ، وكان أقوىها مخطط التدفق. يتطلب تصور كيفية تفاعل المستخدم مع النظام الكثير من الخيال من شخص ينظر إلى المخطط الانسيابي. مع Adobe XD ، يمكن للمصممين الآن الوصول إلى وسيط الصوت ويمكنهم استخدامه في نماذجهم الأولية. يربط XD النماذج الأولية للشاشة والصوت بسلاسة في تطبيق واحد.

تجارب جديدة ، نفس العملية

على الرغم من أن الصوت هو وسيط مختلف تمامًا عن المرئي ، فإن عملية إنشاء النماذج الأولية للصوت في Adobe XD تشبه إلى حد كبير النماذج الأولية لواجهة المستخدم الرسومية. يدمج فريق Adobe XD الصوت بطريقة تبدو طبيعية وبديهية لأي مصمم. يمكن للمصممين استخدام مشغلات الصوت وتشغيل الكلام للتفاعل مع النماذج الأولية:

- تبدأ المشغلات الصوتية تفاعلًا عندما يقول المستخدم كلمة أو عبارة معينة (الكلام).

- يتيح تشغيل الكلام للمصممين الوصول إلى محرك تحويل النص إلى كلام. سوف ينطق XD الكلمات والجمل التي حددها المصمم. يمكن استخدام تشغيل الكلام للعديد من الأغراض المختلفة. على سبيل المثال ، يمكن أن يكون بمثابة إقرار (لطمأنة المستخدمين) أو كدليل (حتى يعرف المستخدمون ما يجب فعله بعد ذلك).

إن الشيء العظيم في XD هو أنه لا يجبرك على تعلم تعقيدات كل منصة صوتية.

يكفي الكلمات - دعنا نرى كيف يعمل. بالنسبة لجميع الأمثلة التي ستراها أدناه ، فقد استخدمت اللوحات الفنية التي تم إنشاؤها باستخدام مجموعة أدوات Adobe XD UI لـ Amazon Alexa (هذا رابط لتنزيل المجموعة). تحتوي المجموعة على جميع الأنماط والمكونات اللازمة لإنشاء تجارب لـ Amazon Alexa.

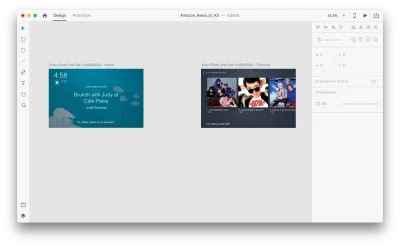

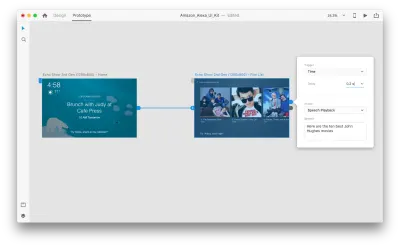

افترض أن لدينا لوحات الرسم التالية:

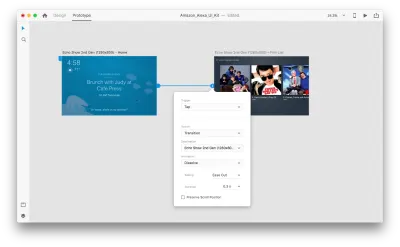

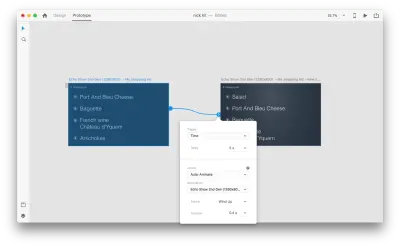

دعنا نذهب إلى وضع النماذج الأولية لإضافة بعض التفاعلات الصوتية. سنبدأ مع مشغلات الصوت. إلى جانب المشغلات مثل النقر والسحب ، يمكننا الآن استخدام الصوت كمحفز. يمكننا استخدام أي طبقات لمشغلات الصوت طالما أن لها مقبض يؤدي إلى لوح رسم آخر. دعنا نربط اللوحات الفنية معًا.

بمجرد القيام بذلك ، سنجد خيار "صوت" جديد ضمن "Trigger". عندما نحدد هذا الخيار ، سنرى حقل "أمر" يمكننا استخدامه لإدخال كلام - وهذا ما سيستمع إليه XD بالفعل. سيحتاج المستخدمون إلى نطق هذا الأمر لتنشيط المشغل.

هذا كل شئ! لقد حددنا تفاعلنا الصوتي الأول. الآن ، يمكن للمستخدمين قول شيء ما ، وسوف يستجيب له نموذج أولي. ولكن يمكننا جعل هذا التفاعل أكثر قوة عن طريق إضافة تشغيل الكلام. كما ذكرت سابقًا ، يسمح تشغيل الكلام للنظام بنطق بعض الكلمات.

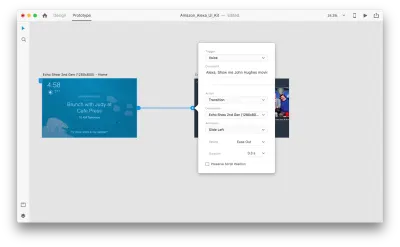

حدد لوحة فنية ثانية كاملة ، وانقر على المقبض الأزرق. اختر مشغّل "الوقت" مع تأخير واضبطه على 0.2 ثانية. تحت الإجراء ، ستجد "تشغيل الكلام". سنقوم بتدوين ما يتحدث به المساعد الافتراضي إلينا.

نحن على استعداد لاختبار نموذجنا الأولي. حدد اللوحة الفنية الأولى ، وسيؤدي النقر فوق زر التشغيل في الجزء العلوي الأيمن إلى تشغيل نافذة المعاينة. عند التفاعل مع النماذج الأولية الصوتية ، تأكد من تشغيل الميكروفون. ثم اضغط مع الاستمرار على مفتاح المسافة لنطق الأمر الصوتي. يؤدي هذا الإدخال إلى تشغيل الإجراء التالي في النموذج الأولي.

استخدم التحريك التلقائي لجعل التجربة أكثر ديناميكية

تجلب الرسوم المتحركة الكثير من الفوائد لتصميم واجهة المستخدم. يخدم أغراضًا وظيفية واضحة ، مثل:

- توصيل العلاقات المكانية بين الأشياء (من أين يأتي الكائن؟ هل هذه الأشياء مرتبطة؟) ؛

- التواصل (ماذا يمكنني أن أفعل بعد ذلك؟)

لكن الأغراض الوظيفية ليست هي الفوائد الوحيدة للرسوم المتحركة ؛ الرسوم المتحركة تجعل التجربة أكثر حيوية وديناميكية. لهذا السبب يجب أن تكون الرسوم المتحركة لواجهة المستخدم جزءًا طبيعيًا من الواجهات متعددة الوسائط.

مع توفر "Auto-Animate" في Adobe XD ، يصبح إنشاء نماذج أولية ذات انتقالات متحركة غامرة أسهل بكثير. يقوم Adobe XD بكل العمل الشاق نيابة عنك ، لذلك لا داعي للقلق بشأن ذلك. كل ما عليك القيام به لإنشاء انتقال متحرك بين لوحين رسميين هو ببساطة تكرار لوح رسم ، وتعديل خصائص الكائن في النسخ (خصائص مثل الحجم والموضع والدوران) ، وتطبيق إجراء تحريك تلقائي. سيقوم XD تلقائيًا بتحريك الاختلافات في الخصائص بين كل لوح رسم.

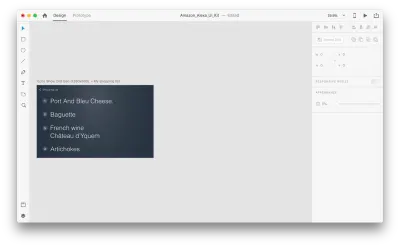

دعونا نرى كيف يعمل في تصميمنا. لنفترض أن لدينا قائمة تسوق حالية في Amazon Echo Show ونريد إضافة عنصر جديد إلى القائمة باستخدام الصوت. قم بتكرار لوح الرسم التالي:

دعنا نقدم بعض التغييرات في التخطيط: أضف كائنًا جديدًا. نحن لسنا مقيدين هنا ، لذلك يمكننا بسهولة تعديل أي خصائص مثل سمات النص واللون والتعتيم وموضع الكائن - بشكل أساسي ، أي تغييرات نجريها ، ستتحرك XD فيما بينها.

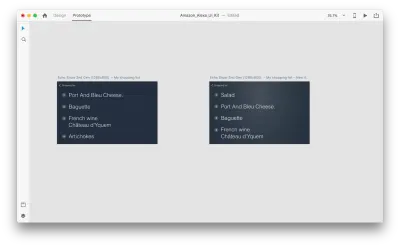

عند توصيل لوحتي رسم معًا في وضع النموذج الأولي باستخدام Auto-Animate في "Action" ، سيقوم XD تلقائيًا بتحريك الاختلافات في الخصائص بين كل لوح رسم.

وإليك كيف سيبدو التفاعل للمستخدمين:

شيء واحد مهم يتطلب ذكره: احتفظ بأسماء جميع الطبقات كما هي ؛ خلاف ذلك ، لن يتمكن Adobe XD من تطبيق الرسوم المتحركة التلقائية.

خاتمة

نحن في فجر ثورة واجهة المستخدم. جيل جديد من الواجهات - الواجهات متعددة الوسائط - لن يمنح المستخدمين المزيد من القوة فحسب ، بل سيغير أيضًا طريقة تفاعل المستخدمين مع الأنظمة. We will probably still have displays, but we won't need keyboards to interact with the systems.

At the same time, the fundamental requirements for designing multimodal interfaces won't be much different from those of designing modern interfaces. Designers will need to keep the interaction simple; focus on the user and their needs; design, prototype, test and iterate.

And the great thing is that you don't need to wait to start designing for this new generation of interfaces. You can start today.

هذه المقالة جزء من سلسلة تصميم UX التي ترعاها Adobe. تم تصميم أداة Adobe XD لعملية تصميم UX سريعة وسلسة ، حيث تتيح لك الانتقال من الفكرة إلى النموذج الأولي بشكل أسرع. التصميم والنموذج الأولي والمشاركة - كل ذلك في تطبيق واحد. يمكنك الاطلاع على المزيد من المشاريع الملهمة التي تم إنشاؤها باستخدام Adobe XD على Behance ، وكذلك الاشتراك في النشرة الإخبارية لتصميم تجربة Adobe للبقاء محدثًا ومطلعًا على أحدث الاتجاهات والرؤى لتصميم UX / UI.